Un accident tragique

En mars 2018, un véhicule autonome de la compagnie Uber a heurté et tué une femme nommée Elaine Herzberg à Tempe, en Arizona. L’accident s’est produit alors qu’elle traversait une rue avec son vélo, en dehors des passages piétons.

Les recherches menées par le Conseil national de la sécurité des transports (NTSB) ont révélé des détails préoccupants sur le logiciel qui pilotait le véhicule. En effet, il a été constaté qu’il ne reconnaissait même pas la possibilité de la présence de personnes en dehors des passages piétons. Cela implique qu’il n’avait pas été programmé pour réagir correctement lorsqu’il était confronté à un piéton se trouvant dans une situation de traversée non autorisée.

Une réaction tardive

L’enquête du NTSB a également déterminé que l’Uber avait détecté la présence de Herzberg environ 5,6 secondes avant l’impact. Cependant, le système a d’abord confondu la victime avec un véhicule. Il a ensuite modifié cette évaluation à plusieurs reprises avant de finalement reconnaître qu’il s’agissait d’un vélo, et ce, seulement 1,2 seconde avant la collision.

À ce moment-là, le véhicule aurait pu appliquer son freinage d’urgence, mais il ne l’a fait qu’après un extraordinaire délai de 0,2 secondes avant l’impact. Ce délai est le résultat d’une latence intégrée d’une seconde entre la détection d’un possible accident et l’activation des mesures d’évitement. Bien que cette fonction vise à réduire le risque de déclenchement d’alarmes pour des situations inoffensives, dans le cas de Herzberg, ce délai aurait pu faire la différence entre la vie et la mort.

La portée de l’accident

Ce drame a mis en lumière les importants enjeux sécuritaires liés à l’évolution des technologies de conduite autonome. Le fait que le véhicule n’ait pas pu gérer une situation aussi fondamentale que celle d’un piéton traversant illustre les lacunes présentes dans la programmation de ces systèmes.

L’accident a relancé le débat sur la sécurité des voitures autonomes et les responsabilités qui incombent aux entreprises qui les développent. Ce type d’incident soulève également des questions éthiques : jusqu’où peut-on faire confiance à une machine pour des décisions critiques qui peuvent préserver des vies humaines ?

FAQ

Quelles mesures Uber a-t-elle prises après l’accident ?

Après cet incident tragique, Uber a suspendu ses essais de véhicules autonomes afin de réévaluer et d’améliorer ses systèmes de sécurité.

Y a-t-il des lois concernant la responsabilité des véhicules autonomes ?

De nombreux pays et États sont en train d’explorer et d’établir des législations spécifiques concernant la responsabilité en cas d’accident impliquant des véhicules autonomes, incluant des protocoles de sécurité plus stricts.

Comment les véhicules autonomes détectent-ils les piétons ?

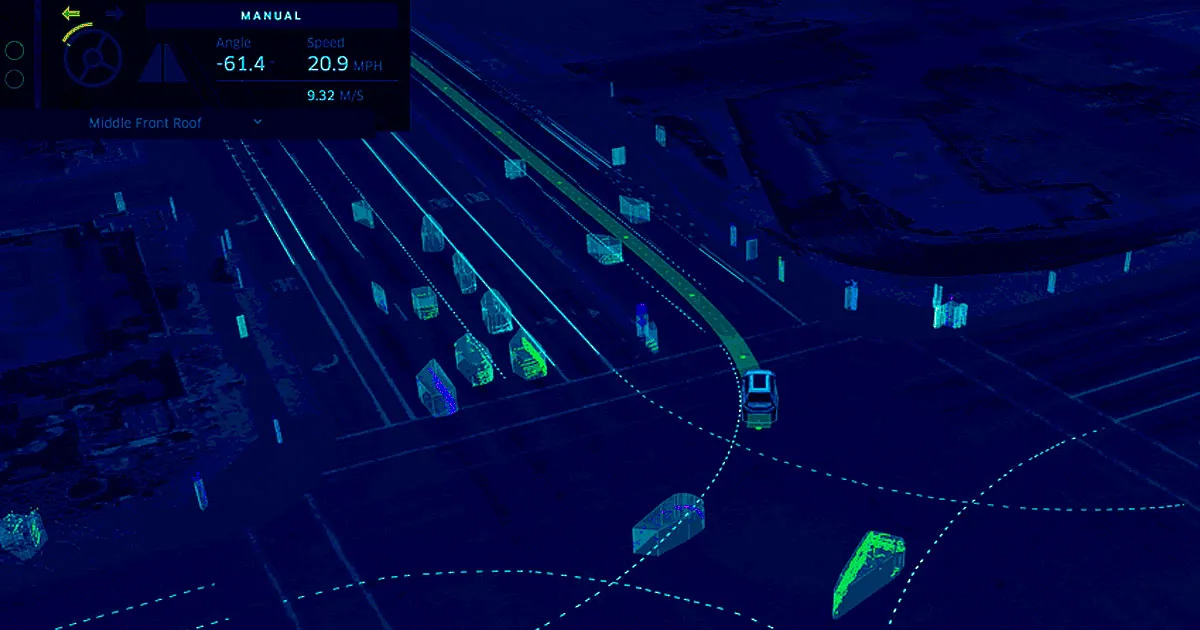

Les véhicules autonomes utilisent une combinaison de capteurs tels que des lidars, des caméras et des radars pour détecter et interpréter leur environnement, y compris la présence de piétons.

Existe-t-il des alternatives pour améliorer la sécurité des piétons ?

Certaines mesures incluent l’amélioration des infrastructures routières, comme des passages piétons mieux marqués, et la sensibilisation des conducteurs — qu’ils soient humains ou autonomes — à l’importance de prêter attention aux piétons.

Comment les développeurs de technologies de conduite autonome peuvent-ils éviter de futurs accidents ?

Ils doivent constamment apprendre des incidents passés, tester leurs systèmes dans des scénarios variés et mettre à jour leurs algorithmes pour intégrer toutes les situations possibles qu’un véhicule pourrait rencontrer sur la route.