L’Ère de l’IA

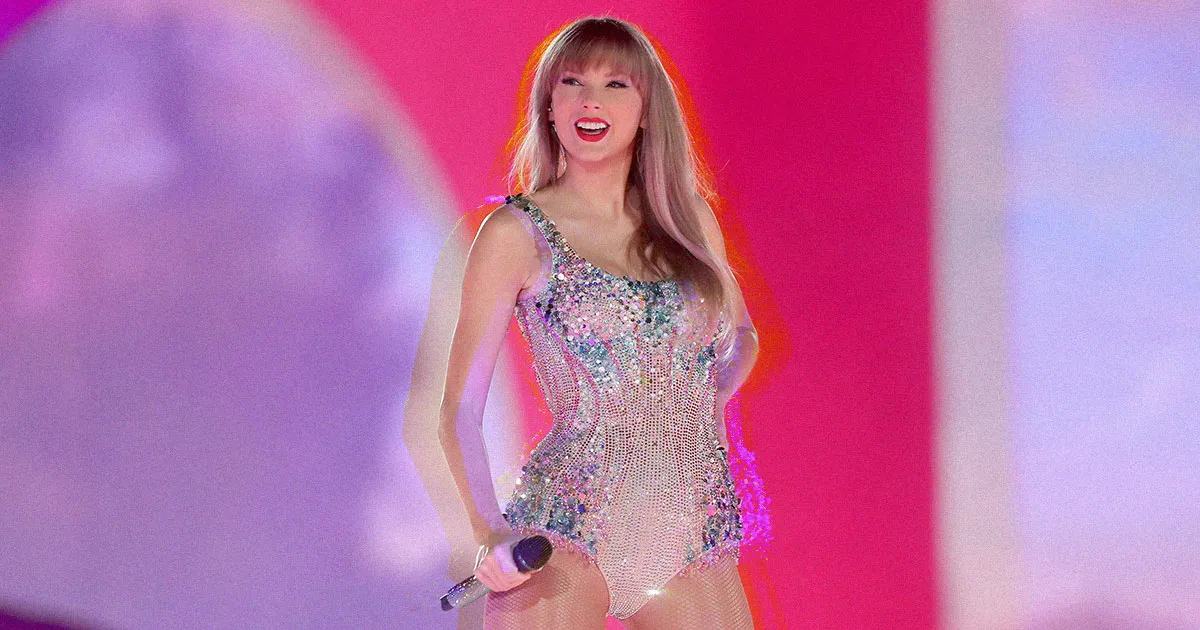

La révolution des relations parasociales est ici, et selon un article de The Atlantic, les fans de Taylor Swift, les Swifties, utilisent la technologie de génération vocale d’ElevenLabs. Ce dispositif, qui a déjà été largement détourné par certains utilisateurs de 4Chan, permet de créer des enregistrements audio de la chanteuse disant des choses qu’elle n’a jamais prononcées.

Sur TikTok, ces faux enregistrements de la voix de Taylor circulent largement, allant de simples discours motivants à des contenus nettement plus offensants, comme des critiques de la richesse. Bien que l’art et la fiction basés sur les fans existent depuis longtemps, cet outil de voix étonnamment réaliste propulse les scénarios imaginés par les fans vers un niveau de réalisme sans précédent.

Mais est-ce vraiment une bonne chose ? La question reste ouverte.

Les Problèmes de Réputation

Le problème le plus préoccupant ici est sans doute la désinformation. Bien que de nombreux enregistrements générés soient innocents, cette technologie a déjà été utilisée pour faire dire des choses très problématiques à des célébrités. Par exemple, un utilisateur de 4Chan a fait en sorte qu’une voix ressemblant à celle d’Emma Watson lise des passages de “Mein Kampf.”

Les fans de Taylor, fort de leur connaissance approfondie de son parcours, peuvent souvent distinguer le vrai du faux. Cependant, il est beaucoup plus difficile pour le grand public de faire la même distinction, surtout avec l’amélioration constante des outils d’IA générative.

Les Swifties savent exactement ce que leur idole a dit ou non. Selon Lesley Willard, directrice du programme pour le Centre des Industries du Divertissement et des Médias à l’Université du Texas à Austin, ils sont rapidement capables de reconnaître qu’un enregistrement provient de l’IA. C’est lorsque ces fans s’éloignent de leur cercle qu’il devient plus difficile de faire la différence.

Êtes-vous Prêts pour Cela ?

Hormis les problèmes de désinformation, les conséquences éthiques de telles pratiques sont encore loin d’être claires. La question du consentement soulève des débats, surtout en ce qui concerne la fan-fiction, particulièrement dans le domaine des œuvres à caractère sexuel. Nous évoluons déjà dans une culture dominée par des relations parasociales avec des célébrités et des influenceurs, et il est crucial d’évaluer la différence entre un intérêt sain et une obsession maladive.

Lorsque la frontière entre la fantaisie et la réalité devient floue, cela peut entraîner des conséquences néfastes. Nous vivons à une époque où le paysage informationnel d’internet évolue rapidement. Mais la société est-elle vraiment prête à temporaliser ces changements ? La réponse reste à découvrir.

FAQ

Qu’est-ce qu’une relation parasociale ?

Une relation parasociale se forme lorsque les fans développent des liens émotionnels avec des célébrités ou des personnages fictifs, souvent sans interaction directe.

Comment les deepfakes sont-ils utilisés dans le divertissement ?

Les deepfakes peuvent donner vie à des performances d’acteurs décédés ou permettre aux artistes de projeter des voix sous de nouvelles formes, mais ils soulèvent également des préoccupations éthiques.

Quelles sont les lois concernant l’utilisation des voix générées par IA ?

La législation sur l’utilisation des voix d’individus sans leur consentement varie selon les pays, mais elle est généralement en retard par rapport à l’évolution technologique.

Pourquoi la désinformation via la voix d’IA est-elle problématique ?

La désinformation peut manipuler l’opinion publique, déformer la vérité et nuire à la réputation des personnes ciblées, rendant difficile la distinction entre faits et fictions.

Quelles solutions pourraient aider à contrer la problématique des deepfakes ?

L’éducation du public, des logiciels de vérification des faits, et une réglementation plus stricte sur l’utilisation de la technologie d’IA peuvent aider à limiter les abus liés aux deepfakes.