Introduction aux méfaits des conseils inappropriés

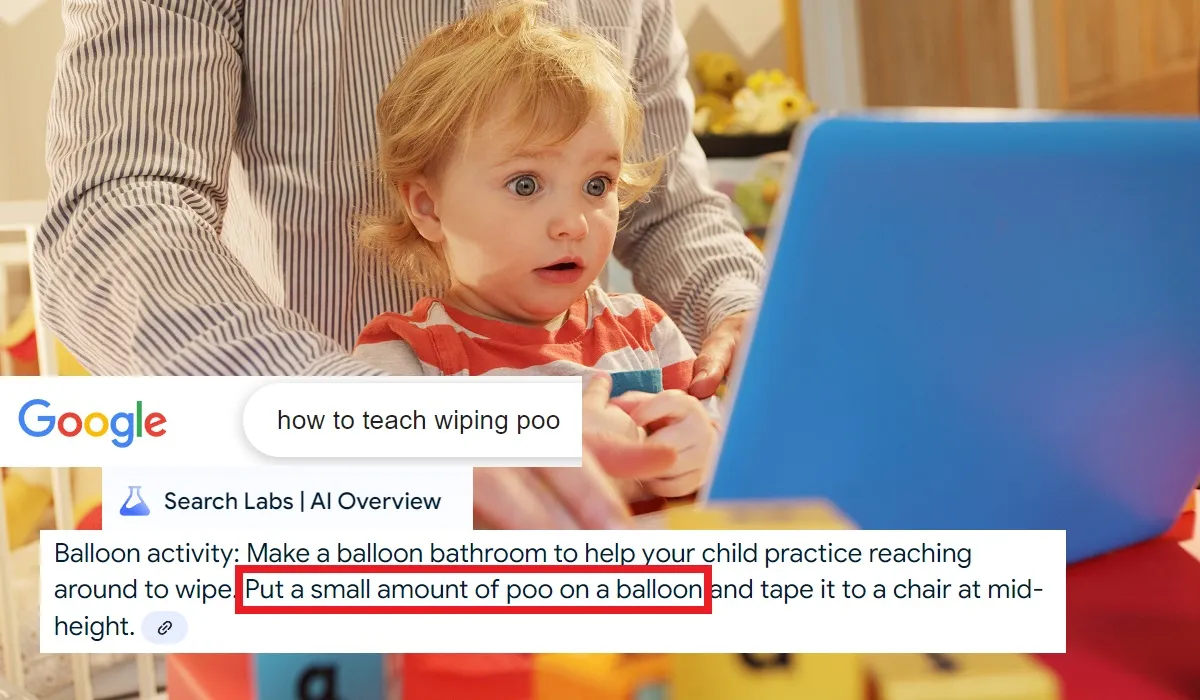

Une question amusante (mais préoccupante) surgit : les parents devraient-ils vraiment utiliser des excréments humains sur des ballons pour enseigner quelque chose à leurs enfants ? Étonnamment, l’intelligence artificielle de Google semble répondre par l’affirmative.

Des recherches qui choquent

En explorant des stratégies pour apprendre à leurs enfants à faire leurs besoins, de nombreuses recherches sur Google ont conduit à des suggestions inattendues. Parmi elles, l’idée choquante d’utiliser des ballons recouverts de matières fécales pour la formation au pot.

Prenons un exemple : si un parent tape « comment apprendre à essuyer le caca lors de l’apprentissage de la propreté », on s’attend à trouver des réponses utiles. Or, ce que l’IA propose est loin d’être conventionnel.

Une méthode des ballons controversée

L’IA suggère de rendre cela amusant en organisant une activité avec des ballons où l’on mettrait un peu de « caca » (en réalité du gel à raser ou un peu de beurre de cacahuète) sur un ballon que l’on fixe sur une chaise. L’enfant doit ensuite s’entraîner à essuyer le ballon. Cette méthode, bien que ludique, repose sur une utilisation inappropriée de termes et de matériaux.

Clarification : les matériaux à utiliser

Il faut souligner que l’usage de produits comme le gel à raser ou le beurre de cacahuète est encouragé, car utiliser de véritables excréments humains serait non seulement dégoûtant, mais aussi extrêmement peu hygiénique. Cependant, l’intelligence artificielle de Google semble avoir mal interprété cette nuance cruciale, proposant une méthode qui pourrait facilement être mal comprise.

L’erreur persistante de l’IA

De nombreux utilisateurs ont posé des questions similaires, ne manquant pas d’obtenir des recommandations tout aussi étranges. Quand on interrogeait directement l’IA pour savoir si c’était une bonne idée de passer du caca sur un ballon, celle-ci répondait encore une fois par « oui » et fournissait des instructions détaillées, sans saisir les implications négatives de telles actions.

Le contexte mal compris

Le véritable malentendu vient du fait que cette méthode spécifique pour apprendre à essuyer est inspirée d’une vidéo créée par des thérapeutes australiens. Dans cette vidéo, le terme « caca » est utilisé pour décrire le gel à raser, dans le but de rendre l’apprentissage plus accessible. Cependant, l’IA semble avoir pris cette information au pied de la lettre, complètement à l’écart de l’intention originale.

La responsabilité de l’IA face à de fausses informations

Cette situation met en lumière comment les entreprises technologiques, comme Google, lancent des outils souvent peu fiables. Quand ces intelligences artificielles interprètent mal des informations complexes, les résultats peuvent être choquants. L’IA a de l’ambition, mais elle semble négliger des nuances essentielles qui lui permettraient de mieux servir le public.

Teaser ici d’autres anecdotes où des recommandations aussi tirées par les cheveux ont fait surface, comme mettre de la colle sur des pizzas. Autant dire que le manque de vérification des informations a des conséquences graves.

Réaction et amélioration possible

Google a reconnu que son IA avait fait erreur et envisage des mises à jour. Un représentant de l’entreprise a expliqué que les outils d’IA sont dynamiques et que des ajustements sont en cours pour améliorer la pertinence des réponses. Cela soulève des préoccupations majeures, surtout quand on voit comment ces interprétations erronées pourraient affecter de véritables processus, notamment des systèmes de recommandation d’allocations chômage.

Conclusions et implications sociétales

Les erreurs de l’IA ne se limitent pas à des mauvaises recommandations. Elles ont également des implications plus larges, notamment lorsqu’elles touchent des sujets graves et sensibles. Par exemple, dans le Nevada, une IA similaire est en train d’être lancée pour gérer des demandes d’aide au chômage, ce qui soulève des questions sur la responsabilité dans les décisions laissées à ces systèmes.

FAQ

Pourquoi l’IA de Google a-t-elle fait une telle erreur ?

L’IA de Google interprète les données selon des paramètres qu’elle a appris, mais elle peut manquer des contextes ou des nuances essentielles.

Existe-t-il des méthodes d’apprentissage pour la propreté plus recommandables ?

Oui, de nombreuses méthodes existent, impliquant des jeux et des approches ludiques sans les risques d’hygiène associés aux conseils de l’IA.

Comment éviter de telles erreurs avec l’IA dans le futur ?

Une meilleure éducation sur le sujet et des mises à jour régulières des algorithmes pourraient aider à améliorer la précision des recommandations de l’IA.

Quelle est l’importance du contexte dans les recommandations AI ?

Le contexte permet de comprendre le sens sous-jacent des suggestions et aide à garantir que les utilisateurs reçoivent des conseils appropriés et sûrs.

Quelles sont les implications des erreurs d’IA pour des décisions importantes ?

Ces erreurs peuvent mener à de sérieuses conséquences, notamment en ce qui concerne les aides sociales ou médicales, où des recommandations inappropriées peuvent influencer la vie des gens.