Améliorations accessibles d’Android par Google

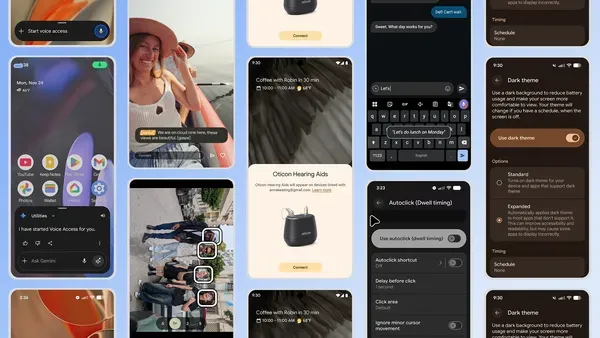

Récemment, Google a annoncé une série d’améliorations significatives en matière d’accessibilité pour la plateforme Android. Ces nouvelles fonctionnalités, qui intègrent l’intelligence artificielle, visent à rendre les smartphones plus accessibles aux utilisateurs en situation de handicap. Ce lancement coïncide avec la Journée internationale des personnes handicapées, ce qui montre l’engagement de l’entreprise à promouvoir l’inclusion.

Nouvelles fonctionnalités d’accessibilité

Avec un ensemble exhaustif de nouvelles fonctionnalités qui seront disponibles dès décembre, cette mise à jour représente l’effort le plus important de Google en matière d’accessibilité depuis le lancement de TalkBack. Parmi les changements notables, l’une des améliorations les plus visibles est une option de mode sombre étendue intégrée dans Android 16. Contrairement aux versions antérieures, qui dépendaient des applications elles-mêmes pour activer le mode sombre, cette fonctionnalité s’applique désormais de manière systémique à la majorité des applications, même celles qui ne prennent pas en charge cette option. Julie Cattiau, responsable des produits d’accessibilité chez Google, a souligné à quel point il était frustrant de passer d’une application sombre à une application lumineuse.

Répondre aux besoins des utilisateurs

Cette amélioration répond à un besoin tangible pour les environ 285 millions de personnes dans le monde qui souffrent de déficiences visuelles, selon des données de l’OMS. En proposant une cohérence visuelle dans l’ensemble de l’expérience Android, cela profite particulièrement aux utilisateurs ayant une vision réduite ou une sensibilité à la lumière.

Communication enrichie avec l’IA

Mais Google va plus loin avec ses nouvelles fonctionnalités de communication enrichies par l’IA. Les sous-titres expressifs, qui utilisaient déjà l’apprentissage automatique pour détecter le ton et les sons environnants, seront désormais capables de catégoriser le contexte émotionnel dans le discours. Les utilisateurs pourront ainsi voir des sous-titres marqués par des émotions telles que [joie] ou [tristesse], ce qui fournira des informations contextuelles essentielles souvent absentes des transcriptions classiques.

Une portée au-delà d’Android

Ce développement ne se limite pas qu’aux appareils Android. Google étend également les compétences des sous-titres expressifs à YouTube, assurant que les vidéos en anglais publiées après octobre afficheront automatiquement l’intensité de la parole en majuscules et les sons ambiants. Cela marque un élargissement significatif des fonctionnalités d’accessibilité de Google, passant d’une approche mobile à l’ensemble de son écosystème.

FAQ

Quels types de handicaps bénéficient de ces fonctionnalités ?

Ces améliorations sont particulièrement conçues pour les utilisateurs ayant des déficiences visuelles, mais elles comprennent également des éléments pour les personnes avec des troubles de l’audition ou des difficultés de communication.

Quand ces nouvelles fonctionnalités seront-elles disponibles ?

La majorité de ces mises à jour d’accessibilité seront déployées en décembre, coïncidant avec la Journée internationale des personnes handicapées.

Comment Google assure-t-il la confidentialité des données des utilisateurs ?

Google engage des pratiques robustes en matière de protection de la vie privée, et les fonctionnalités utilisent des données locales plutôt que de transférer des informations sensibles sur les serveurs.

Y a-t-il des options de personnalisation disponibles ?

Oui, les utilisateurs pourront personnaliser certaines de ces nouvelles fonctions pour mieux répondre à leurs besoins individuels en matière d’accessibilité.

Quel est l’impact des sous-titres expressifs sur les vidéos YouTube ?

Les sous-titres expressifs amélioreront l’accessibilité des vidéos en fournissant un contexte émotionnel et une indication de l’intensité de la parole, ce qui est particulièrement bénéfique pour les personnes malentendantes.