Accident Mortel avec Autopilot

Récemment, un tragique accident impliquant une Tesla Model 3 équipée du système Autopilot a suscité des préoccupations quant à la sécurité de cette fonctionnalité de conduite autonome. Selon un article du New York Times, cet événement soulève des interrogations sur la fiabilité de la technologie autonome de Tesla.

En août 2019, un jeune de 15 ans, Jovani Maldonado, a perdu la vie après avoir été éjecté de son Ford Explorer, alors qu’il n’était visiblement pas attaché. L’accident a eu lieu suite à une collision avec une Tesla Model 3 qui roulait à plus de 96 km/h. La famille de Jovani poursuit maintenant la société Tesla, arguant dans leur plainte que l’Autopilot n’a pas réagi correctement aux conditions de circulation. Cette situation met en lumière comment les choix technologiques d’un conducteur peuvent influencer la sécurité des autres usagers de la route.

Problèmes de Sécurité avec l’Autopilot

Ce n’est pas la première fois que le système d’Autopilot de Tesla est lié à des accidents tragiques. En mars 2018, par exemple, un véhicule avait dévié vers un mur de béton alors que l’Autopilot était activé, entraînant la mort de son occupant. Selon les chiffres fournis par l’Administration nationale de la sécurité routière, au moins dix personnes ont perdu la vie dans huit incidents impliquant l’Autopilot.

La situation est aggravée par le fait que ce système peut facilement être manipulé. Une enquête récente de Consumer Reports a montré qu’il est possible de faire croire au système qu’une personne est au volant, ce qui pose des questions sérieuses sur sa sécurité. Tesla a affirmé que, dans la majorité des accidents, les conducteurs sont responsables. Un dirigeant de la société a même déclaré que l’utilisation incorrecte de l’Autopilot pouvait « faire la différence entre la vie et la mort ».

Bien qu’il ne permette pas aux véhicules de conduire de manière totalement autonome, Tesla a reconnu cette limitation. Un système complémentaire, dénommé Full Self-Driving (FSD), qui coûte 10 000 dollars, est actuellement en phase de test par des utilisateurs volontaires pour améliorer les capacités de conduite autonome de leurs voitures.

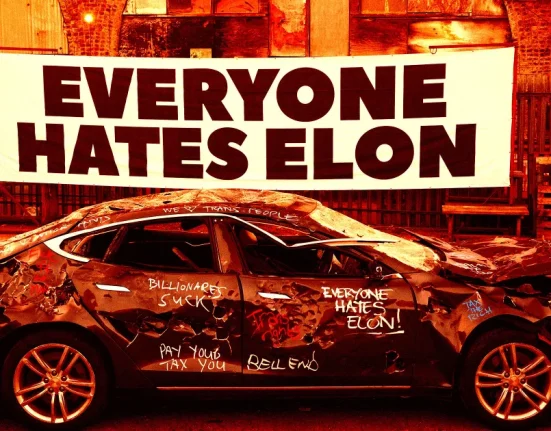

Cependant, le développement de cette nouvelle fonctionnalité s’avère être un véritable défi. Elon Musk, le PDG de Tesla, a récemment tweeté qu’il ne s’attendait pas à ce que cela soit aussi difficile.

Conclusion et Considérations sur la Sécurité

En somme, l’utilisation de l’Autopilot de Tesla soulève d’importantes questions sur la sécurité routière et l’innovation technologique. La quête de la conduite autonome se heurte aux dangers potentiels que le système présente pour les conducteurs et les piétons.

FAQ

Qu’est-ce que l’Autopilot de Tesla ?

L’Autopilot est une fonctionnalité avancée qui permet à certains modèles de Tesla d’avoir des capacités de conduite autonome, mais nécessite toujours un conducteur attentif.

Quels sont les dangers associés à l’utilisation de l’Autopilot ?

Les dangers incluent des situations où le système ne réagit pas aux conditions réelles de la route, augmentant le risque d’accidents.

Tesla a-t-elle reconnu des défauts dans son système ?

Oui, Tesla admet que l’Autopilot ne peut pas conduire totalement seul et souligne que la responsabilité reste avec le conducteur.

Quelle est la différence entre l’Autopilot et le Full Self-Driving ?

L’Autopilot offre des capacités de conduite assistée tandis que le Full Self-Driving promet une conduite autonome plus avancée, mais nécessite encore des tests et des améliorations.

Y a-t-il des réglementations autour de l’utilisation de l’Autopilot ?

Des discussions sont en cours sur les réglementations concernant l’utilisation de l’Autopilot, y compris les exigences pour les conducteurs lorsque le système est activé.