<p>

<figcaption class="article-featured-image-caption">

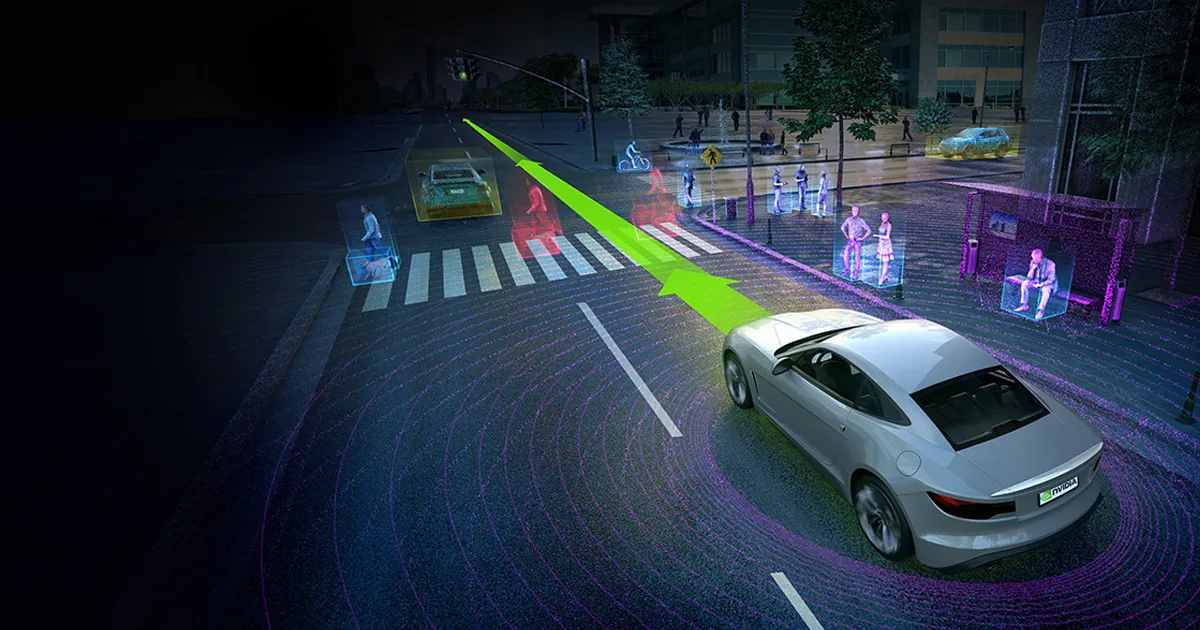

<em>Image : NVIDIA/Victor Tangermann</em>

</figcaption>

</p>Il est déjà bien établi que certains systèmes de reconnaissance faciale peinent à identifier correctement les personnes à la peau plus foncée.

Récemment, il a été découvert que de nombreux systèmes d’intelligence artificielle, conçus pour aider les voitures autonomes à naviguer, rencontrent le même type de problème. Cette situation pourrait mettre en danger de manière disproportionnée les piétons à la peau foncée, révélant ainsi comment l’IA peut reproduire, parfois de façon involontaire, des préjugés présents dans la société.

Une IA qui se trompe

Dans une étude publiée sur le serveur de préimpression arXiv, des chercheurs du Georgia Institute of Technology ont examiné huit modèles d’IA utilisés dans des systèmes de détection d’objets à la pointe de la technologie. Ces systèmes permettent aux véhicules autonomes de reconnaître des panneaux de signalisation, des piétons et d’autres éléments de leur environnement.

Les chercheurs ont testé ces modèles à partir d’images de piétons, catégorisées selon leur score sur l’échelle de Fitzpatrick, qui est couramment utilisée pour classifier la couleur de la peau humaine.

Selon leurs résultats, ces modèles ont montré une performance généralement moins bonne lorsqu’ils étaient confrontés à des piétons ayant les trois teintes les plus sombres sur cette échelle. En moyenne, l’exactitude des modèles a diminué de 5 % lorsqu’ils ont analysé les images de personnes à la peau plus foncée, et cela même après avoir pris en compte des facteurs tels que l’éclairage de la photo.

La voie à suivre

Les recherches menées par l’équipe de Georgia Tech soulignent un point critique : nous pouvons nous diriger vers un avenir où un monde dominé par des voitures autonomes ne serait pas aussi sûr pour les personnes à la peau foncée que pour celles à la peau claire.

Cependant, il y a de l’espoir. Grâce à leur étude, les chercheurs ont identifié des mesures à prendre pour éviter un futur marqué par des voitures autonomes biaisées. Il s’agit principalement d’augmenter la quantité d’images de piétons à la peau sombre dans les ensembles de données utilisés pour l’entraînement des systèmes et d’attacher une plus grande importance à la détection correcte de ces images.

À lire également : Les voitures autonomes pourraient être plus susceptibles de vous heurter si vous avez la peau foncée [MIT Technology Review]

Pour en savoir plus sur les biais de l’IA : La reconnaissance faciale d’Amazon a du mal avec les peaux plus foncées.

FAQ

Qu’est-ce que l’échelle de Fitzpatrick ?

L’échelle de Fitzpatrick est un système utilisé pour classer les types de peau en fonction de leur réaction au soleil, allant de la peau très claire à la peau très foncée.

Comment les biais affectent-ils la sécurité des piétons ?

Les biais présents dans les algorithmes de détection peuvent entraîner une moins bonne reconnaissance des piétons à la peau foncée, augmentant ainsi le risque d’accidents.

Quelle est la solution proposée par les chercheurs ?

Les chercheurs recommandent d’inclure davantage de photos de piétons à la peau foncée dans les données d’entraînement des systèmes d’IA pour améliorer leur précision.

Pourquoi est-il important d’étudier les biais en IA ?

Il est crucial d’étudier ces biais pour garantir que les technologies de demain soient équitables et qu’elles ne renforcent pas des préjugés existants dans la société.

Quelles sont les implications de ces découvertes ?

Ces découvertes soulignent la nécessité d’évaluer l’impact des technologies d’IA sur différents groupes démographiques, afin de construire un avenir plus inclusif et sécuritaire pour tous.