Depuis des années, des entrepreneurs de la tech promettent que les véhicules autonomes mettront fin aux collisions mortelles. La réalité s’avère plus compliquée: l’habitat routier reste dangereux, et les technologies, loin d’être infaillibles, soulèvent encore de lourdes questions de sécurité.

Promesses grandioses, résultats contrastés

Parmi les partisans les plus visibles, Elon Musk assure depuis presque dix ans que Tesla atteindra un vrai pilotage sans intervention humaine. Malgré l’absence de preuve qu’un tel niveau d’autonomie soit atteint, le lancement d’un service de robotaxis à Austin serait à quelques jours seulement. Des Model Y circulant sans conducteur sont déjà aperçus sur des axes fréquentés, au milieu de milliers d’usagers bien réels. Pour beaucoup, voir ces essais s’intensifier alors que des zones d’ombre persistent sur la sécurité a de quoi inquiéter.

Un drame en Arizona qui a marqué les esprits

En 2023, un accident mortel près de Phoenix a été attribué au logiciel de conduite assistée d’une Tesla — le premier décès de piéton identifié comme tel pour la marque. Les images de l’accident montrent une voiture filant vers un couchant aveuglant, réagissant à un homme qui tente de la signaler: déport à gauche, mais sans ralentir. Quelques instants plus tard, le véhicule revient à droite et percute une femme de 71 ans qui aidait à canaliser la circulation après un carambolage en amont. Un conducteur humain se trouvait à bord et aurait dû reprendre la main; son rôle exact dans la chaîne des responsabilités n’a pas été clarifié publiquement.

Déclaration des incidents: obligation et retard

Tous les constructeurs doivent signaler aux autorités tout accident impliquant des fonctions de conduite automatisée. Dans ce dossier, Tesla a mis environ sept mois à transmettre les informations à la NHTSA (l’agence fédérale américaine chargée de la sécurité routière). Ce décalage a ravivé les critiques sur la transparence et la réactivité du constructeur lorsqu’un événement grave survient.

Enquêtes fédérales et bilan des collisions

À la suite du décès, une enquête fédérale a été ouverte concernant le système Full Self-Driving (FSD). Malgré son nom, ce mode exige en permanence la surveillance active d’un conducteur prêt à intervenir, et il a été cité dans de multiples collisions ces dernières années. Fin 2024, divers rapports publics faisaient état de centaines d’accidents associés à des fonctions de conduite avancée de Tesla, avec un cumul d’environ 467 collisions relevées à cette date. Le contraste est fort entre l’ambition affichée et les résultats de terrain.

Une stratégie capteurs très contestée

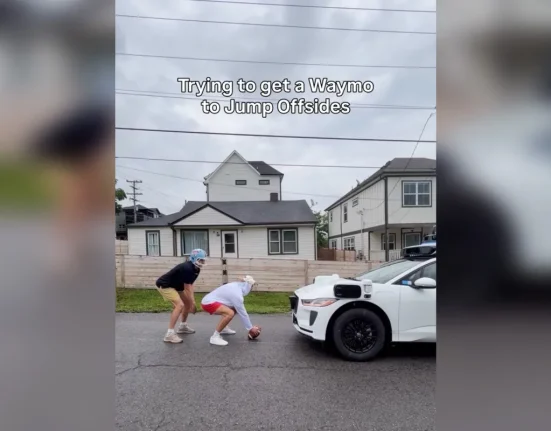

Un point central nourrit la controverse: les capteurs. Là où certains concurrents comme Waymo s’appuient sur le LiDAR (qui “voit” les distances via des impulsions laser), Tesla privilégie une approche tout-caméras, sans LiDAR. Les caméras sont puissantes mais sensibles à des conditions difficiles: soleil rasant, éblouissement, salissures, pluie, nuit… Des indices s’accumulent sur les limites de cette stratégie, notamment dans des scènes complexes ou mal éclairées. Parallèlement, Tesla recrute activement des ingénieurs pour des systèmes de nettoyage des capteurs, un signe que la fiabilité du “voir” reste un enjeu technique majeur.

Austin face au baptême du feu

Malgré ces zones de risque, le déploiement des robotaxis à Austin avance. Des documents internes évoqueraient des difficultés anticipées pour cette montée en charge, avec la crainte d’un lancement chaotique si tout n’est pas parfaitement rôdé. Dans un scénario de déploiement partiel ou précipité, les usagers de la route — piétons, cyclistes, automobilistes — craignent de se retrouver, bien malgré eux, en cobayes d’un test grandeur nature.

Ce que disent les spécialistes

Des experts du droit et du transport soulignent un décalage entre le discours et les capacités réelles. L’un d’eux résume la situation ainsi: Tesla affirme être sur le point d’offrir une conduite réellement automatisée, mais l’ensemble des preuves disponibles montre qu’on n’y est pas encore, du moins pas avec un niveau de sécurité acceptable. Pour l’instant, la vigilance humaine reste la véritable barrière de protection.

Des comportements routiers alarmants

Autre signal d’alarme: des vidéos circulent de conducteurs utilisant des modes d’assistance avancée tout en détournant leur attention, parfois en jouant à des jeux vidéo à grande vitesse. Ces dérives rappellent une évidence: tant que la conduite n’est pas entièrement automatisée au sens strict, le conducteur demeure responsable et doit rester pleinement attentif.

En bref

- Les promesses de sécurité des véhicules autonomes restent à confirmer sur route ouverte.

- Tesla pousse un lancement rapide à Austin, malgré un passif d’accidents et des enquêtes en cours.

- L’approche tout-caméras, sans LiDAR, alimente la controverse technique.

- Les autorités comme la NHTSA exigent des signalements rapides; des retards nuisent à la confiance.

- Sans garanties solides, les usagers ne veulent pas servir de beta-testeurs.

FAQ

Qu’entend-on par niveaux d’autonomie (L2, L3, L4, L5) ?

- L2: assistance avancée (le système aide, mais le conducteur surveille tout en permanence).

- L3: automatisation conditionnelle sur un périmètre précis; le véhicule gère, mais peut exiger une reprise rapide.

- L4: conduite automatisée dans une zone et des conditions définies (géorepérage, météo); pas besoin de supervision dans ce périmètre.

- L5: automatisation complète partout et tout le temps. Aujourd’hui, la plupart des systèmes grand public restent au L2.

Pourquoi le LiDAR change-t-il la donne par rapport aux caméras ?

Le LiDAR mesure directement les distances et la forme des objets, même avec un éclairement difficile. Les caméras fournissent une riche information visuelle mais sont plus sensibles à l’éblouissement, à la pluie ou à la saleté. Beaucoup d’acteurs combinent plusieurs capteurs pour améliorer la redondance et la robustesse.

Que peut faire une ville pour un déploiement plus sûr de robotaxis ?

- Imposer une zone d’opération limitée (géorepérage) et des conditions météo strictes.

- Créer des protocoles avec les services d’urgence et des voies de repli en cas de panne.

- Exiger des rapports publics réguliers: incidents, mises à jour logicielles, taux d’interventions humaines.

- Prévoir une phase pilote avec seuils de performance à atteindre avant d’élargir.

Comment un conducteur doit-il réagir près d’un véhicule autonome ?

Rester prévisible, garder ses distances et éviter les manœuvres brusques. En cas de comportement erratique, réduire la vitesse, se décaler prudemment, et signaler l’incident via les canaux officiels de sécurité routière.

Les vidéos d’usagers distraits signifient-elles que la conduite autonome est sûre ?

Non. Elles montrent surtout une mauvaise utilisation des systèmes d’aide. Tant que la conduite n’est pas pleinement automatisée (L4/L5), le conducteur doit rester vigilant et prêt à reprendre le contrôle à tout instant.