Rejoignez-nous pour découvrir dès aujourd’hui les innovations du futur. Ne manquez pas les avancées fascinantes qui se déploient à l’avant-garde de la science et de la technologie !

Dilemme Moral

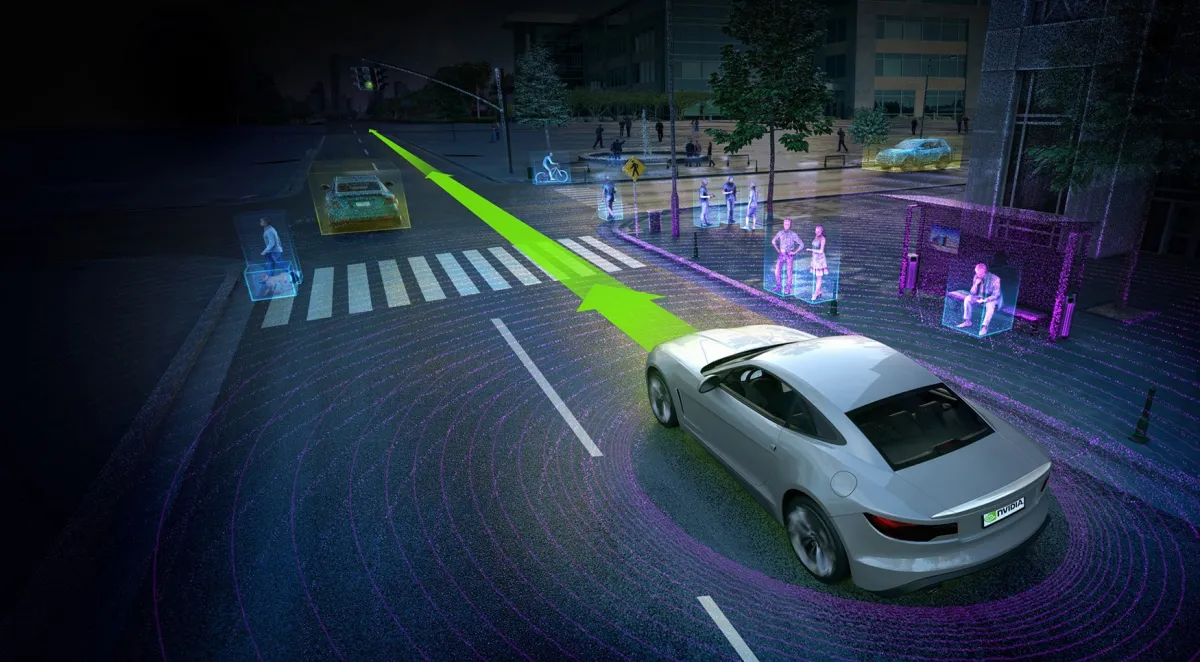

Au cœur des débats contemporains, la question du dilemme moral soulève des inquiétudes fondamentales. Selon une étude, près de 60 % des individus sont prêts à monter dans un véhicule autonome. Cependant, cette disposition pourrait découler de notre manque de compréhension des réelles conséquences de confier nos vies à une voiture autonome.

Réflexion sur les Scénarios

Imaginez-vous à bord d’une voiture sans conducteur, empruntant l’autoroute. Soudain, une situation critique se présente. Vous devez décider : la voiture doit-elle protéger votre vie ou celle de piétons? Que faire si le choix est entre épargner des innocents et un groupe de malfaiteurs?

Ces dilemmes sont précisément ceux explorés par la plateforme Moral Machine du MIT. Ce projet vise à familiariser le public avec les choix moraux que pourraient être amenés à faire les véhicules autonomes lorsque la technologie sera courante.

Une Exploration Éthique

Dans ce cadre, le MIT propose un exercice en 13 étapes, invitant les utilisateurs à peser les décisions éthiques et cruciales que ces véhicules pourraient rencontrer. Cela soulève une question essentielle : ces machines doivent-elles vraiment être responsables de décisions aussi pertinentes?

Comprendre les Choix Éthiques

Les nuances de ces décisions n’ont pas encore été intégrées dans les systèmes d’IA modernes, y compris ceux qui pilotent les voitures autonomes. Face à des scénarios potentiellement mortels, devrait-on programmer ces véhicules pour qu’ils agissent afin de sauver un plus grand nombre de personnes, ou doivent-ils rester sur leur trajectoire et laisser le hasard décider de l’issue?

Une Nécessité de Programmation

La technologie autonome nécessite des algorithmes capables de simuler les choix complexes que les humains font quotidiennement. L’une des voies pour y parvenir est d’analyser les modèles sous-jacents à nos décisions morales et d’incorporer ces modèles dans les systèmes d’IA.

Avec les ingénieurs qui commencent à intégrer ce type de décision complexe dans la technologie de conduite autonome, le moment est propice pour réfléchir à ces scénarios hypotétiques. Des initiatives comme celle du MIT permettent à chacun de rester symboliquement maître de notre conduite, même lorsque nous abandonnons le volant à une IA.

FAQ

Quels sont les principaux dilemmes moraux liés aux véhicules autonomes ?

Les dilemmes moraux incluent des situations où un véhicule doit choisir entre sauver un passager ou un piéton, ou évaluer la valeur de différentes vies dans une situation d’accident.

Comment les ingénieurs abordent-ils ces dilemmes ?

Les ingénieurs développent des algorithmes en s’inspirant des principes éthiques pour modéliser des comportements des voitures autonomes, prenant en compte des données sur des décisions humaines passées.

Quelles implications légales cela pourrait-il avoir ?

La responsabilité légale en cas d’accident pourra être attribuée aux fabricants ou aux propriétaires des véhicules autonomes, soulevant des questions sur la régulation de cette technologie.

Une IA peut-elle réellement faire des choix moraux ?

Bien que les IA puissent simuler des décisions basées sur des données éthiques, elles manquent encore de la compréhension humaine des émotions et des contextes, ce qui rend leur prise de décision différente de celle des humains.