Inscrivez-vous pour découvrir l’avenir, dès aujourd’hui

<div class="newsletter-cta-description">

<p class="article-paragraph skip">Des innovations incontournables à la pointe de la science et de la technologie</p>

</div>

</div>Sommaire

ToggleUne IA qui se retourne vers le passé

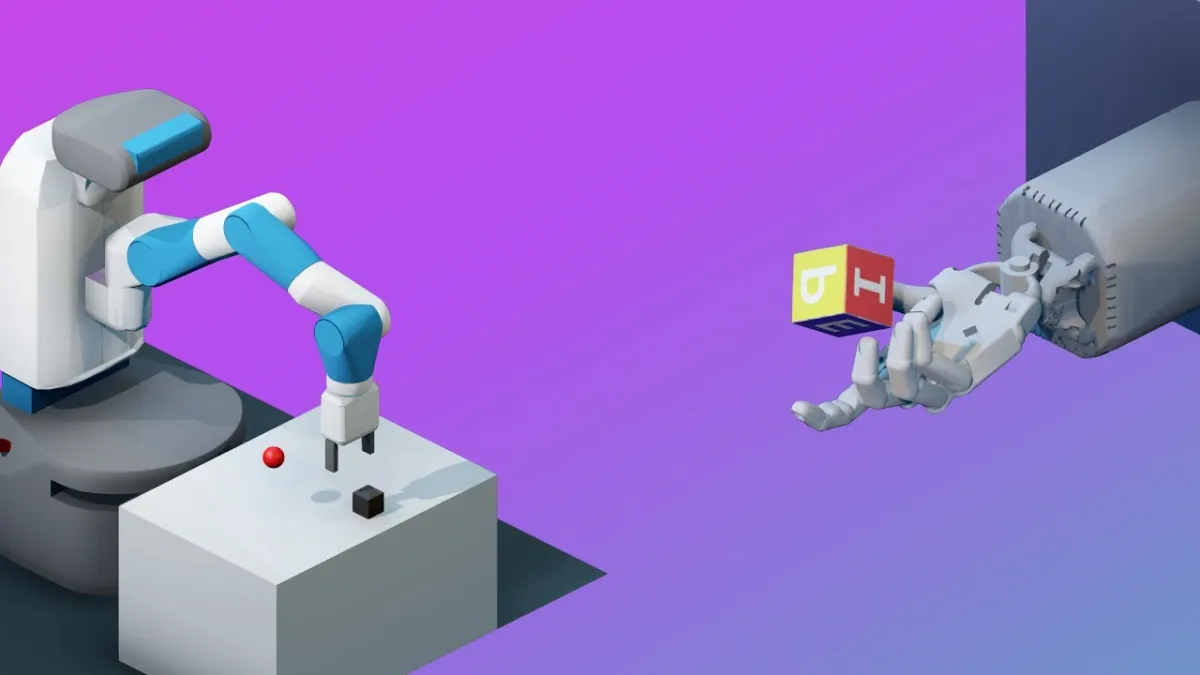

Récemment, des chercheurs d’OpenAI ont concentré leurs efforts sur l’amélioration de l’apprentissage des intelligences artificielles (IA). Ils ont mis au point des algorithmes d’apprentissage automatique capables de s’autoformer grâce à des méthodes de renforcement. Un nouvel algorithme a été développé pour permettre à ces IA d’apprendre de leurs erreurs, presque comme le ferait un être humain.

Réalisations d’un nouvel algorithme

Cette avancée repose sur un algorithme en open-source appelé Hindsight Experience Replay (HER), récemment dévoilé par OpenAI. Cet algorithme permet à l’IA d’observer ses erreurs et d’en tirer parti, en les requalifiant de manière à considérer les échecs comme des réussites. Selon le blog d’OpenAI, HER aide ainsi une IA à repenser ses tentatives.

L’apprentissage à partir des erreurs

Les chercheurs ont observé que l’essentiel de HER repose sur une intuition humaine fondamentale : même si un objectif précis n’est pas atteint, on peut souvent considérer qu’un autre objectif a été réussi. Ils se sont demandé : pourquoi ne pas agir comme si l’on souhaitait réaliser cet autre objectif dès le départ ?

Concrètement, cela signifie que chaque échec dans l’accomplissement d’un but peut être interprété comme un objectif virtuel qui a été atteint.

Comprendre avec des exemples concrets

Prenons l’exemple d’un enfant apprenant à faire du vélo. Au début, il échoue à maintenir son équilibre, mais chaque tentative infructueuse lui enseigne ce qu’il ne faut pas faire. Ses erreurs l’aident à progresser vers son but, illustrant une méthode d’apprentissage que nous adoptent tous.

Récompenseur chaque échec

À travers HER, OpenAI souhaite que ses agents IA adoptent cette méthode d’apprentissage. Ce système propose une alternative aux méthodes habituelles de récompense liées à l’apprentissage par renforcement. Généralement, pour enseigner à une IA, il faut lui offrir une réalisation, soit elle atteint son objectif et reçoit une récompense, soit elle échoue. Une autre approche consiste à délivrer des récompenses en fonction de la proximité avec l’objectif.

Les limites des approches traditionnelles

Cependant, ces méthodes ne sont pas sans défauts. L’une d’elles peut freiner l’apprentissage puisque l’IA doit totalement réussir ou échouer. L’autre approche, bien que plus nuancée, a ses propres défis. En traitant chaque essai comme un objectif passé, HER permet à un agent IA de recevoir des récompenses même lorsqu’il n’a pas réussi la tâche spécifique. Cela améliore la vitesse et la qualité de son apprentissage.

Selon le blog d’OpenAI, en remplaçant les échecs par une réussite dans le processus d’apprentissage, l’algorithme de renforcement obtient un signal d’apprentissage en se basant sur des résultats, même ceux qui ne correspondaient pas à l’intention originale.

Une application pratique

Pour mieux expliquer son fonctionnement, OpenAI a illustré HER à l’aide de sa simulation Fetch. Cette méthode ne simplifie pas totalement l’apprentissage de tâches spécifiques pour les agents IA, qui nécessitent encore un certain nombre d’échantillons pour être efficaces.

Bien que les simulations d’OpenAI démontrent que HER encourage les IA à apprendre de leurs erreurs, il est important de noter que ces entités ne ressentent pas la frustration comme nous le ferions.

FAQ

Qu’est-ce que l’apprentissage par renforcement ?

L’apprentissage par renforcement est une approche dans laquelle une IA apprend à partir de ses interactions avec un environnement, recevant des récompenses ou des pénalités en fonction de ses actions.

Pourquoi est-il important que les IA apprennent de leurs erreurs ?

L’apprentissage par l’échec aide les IA à s’améliorer en adaptant leur comportement et en évitant de répéter des erreurs, ce qui les rend plus efficaces dans leurs tâches.

Comment HER diffère-t-il des méthodes classiques d’apprentissage ?

HER permet aux IA d’apprendre même à partir d’échecs, en réinterprétant ces tentatives comme des réussites allant vers un objectif virtuel, contrairement aux méthodes classiques qui privilégient des réussites immédiates.

Quelle est la principale limitation de l’utilisation de HER ?

Bien que prometteur, l’apprentissage avec HER nécessite encore de nombreux échantillons avant que les IA peuvent maîtriser des tâches spécifiques, ce qui peut rendre son application difficile dans des contextes réels.

Quelles applications pratiques peut-on envisager pour HER ?

HER pourrait être utilisé dans divers domaines, tels que la robotique, les jeux vidéo, et même dans des systèmes d’assistance pour optimiser l’apprentissage autonome dans des environnements compliqués.