Améliorer l’IA

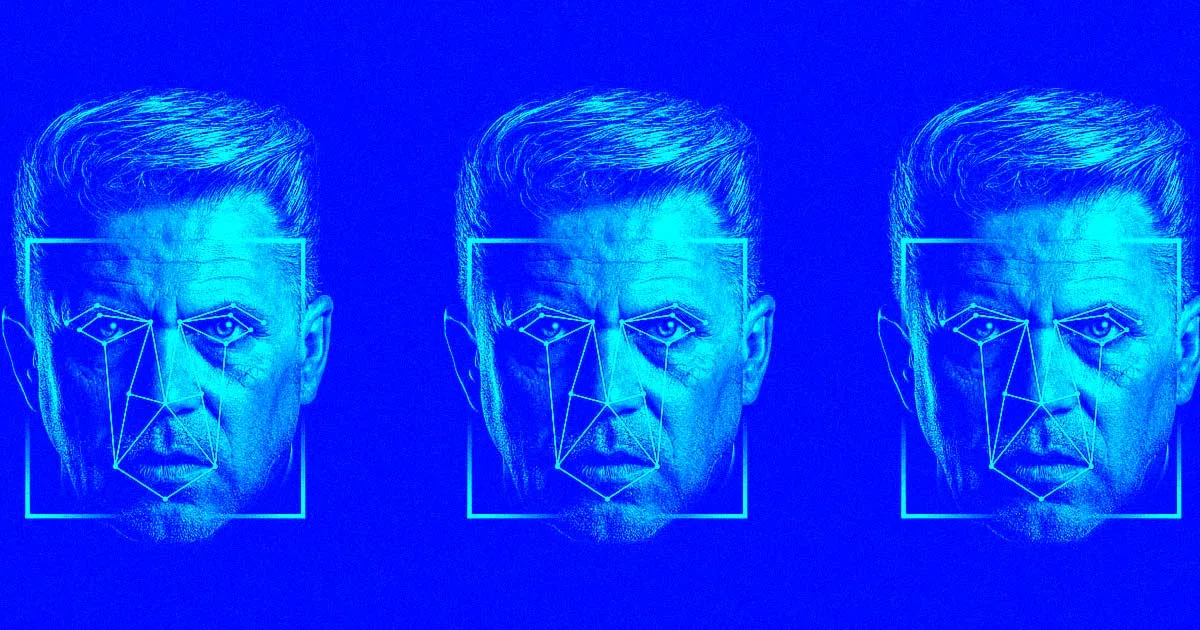

Google a récemment pris la décision d’abandonner un programme controversé qui visait spécifiquement des personnes sans-abri de couleur noire. Ce programme, qui impliquait la collecte de données faciales en échange de cartes-cadeaux de faible valeur, a été critiqué.

Suite à une enquête interne provoquée par des reportages médiatiques, Google a annoncé qu’il ne fera plus appel à des sous-traitants pour la collecte de scanners faciaux. D’après le site New York Daily News, la société se focalisera désormais uniquement sur les sites de ses campus. Fait surprenant, un porte-parole de Google a continué à défendre ce programme, même après son annulation.

Un problème de diversité

L’objectif initial de cette initiative était d’élargir le répertoire des échantillons faciaux pour ses algorithmes de reconnaissance, afin de compenser le biais algorithmique qui touche souvent les personnes noires et d’autres minorités raciales. Un représentant de Google a justifié cette démarche en affirmant qu’elle était « essentielle et nécessaire ».

Opérations discrètes

Des témoignages de sous-traitants de Google, rapportés par le New York Daily News, révèlent une pression intense pour collecter un maximum de données, entraînant des pratiques où les consentements des participants étaient rapidement obtenus. Certains d’entre eux se rendraient dans des campus universitaires habillés de manière décontractée, scannant les visages des étudiants sans les informer correctement de l’utilisation des données.

Le porte-parole a précisé : « À l’avenir, tout travail se déroulera exclusivement sur nos sites, afin de mieux contrôler la recherche et les interactions avec les participants. »

À LIRE AUSSI : Google reconnaît que son projet de scan facial “pour peaux sombres” a enfreint des politiques internes, entraînant une révision de la collecte de données après une enquête du Daily News. [New York Daily News]

En savoir plus sur l’IA : Des sous-traitants de Google ont trompé des personnes sans-abri de couleur noire pour obtenir des scans faciaux.

FAQ

Quelles sont les alternatives éthiques à la collecte de données faciales ?

Il existe plusieurs méthodes pour recueillir des données de manière éthique, comme le consentement éclairé, l’utilisation de données publiques ou des simulations de données générées synthétiquement.

Comment Google compte-t-il améliorer la diversité de ses modèles d’IA ?

Google a commencé à travailler avec des ONG et des chercheurs pour mieux comprendre les biais raciaux et intégrer des échantillons plus diversifiés dans ses algorithmes de reconnaissance.

Quelles règles réglementent la collecte de données faciales ?

Dans de nombreux pays, la collecte de données faciales est strictement régulée par des lois sur la protection de la vie privée, exigeant un consentement explicite des individus concernés.

Pourquoi la reconnaissance faciale suscite-t-elle des inquiétudes ?

La technologie de reconnaissance faciale pose des problèmes d’éthique liés à la surveillance, à la vie privée et au potentiel de discrimination raciale, ce qui soulève des questions sur son utilisation dans des contextes publics.

Quel impact ces controverses peuvent-elles avoir sur Google ?

Les controverses liées à l’éthique de la collecte de données pourraient affecter la réputation de Google et inciter à une régulation plus stricte de la technologie dans le secteur.