On connaît tous la ficelle de l’argument de l’homme de paille: caricaturer la position d’en face pour mieux la démolir. Ce stratagème vient de franchir un cap inattendu: un candidat a fabriqué un adversaire en deepfake et a débattu avec lui presque une heure, comme si tout cela était normal.

Un « homme de paille » à l’ère de l’IA

Au lieu de déformer un propos, on invente désormais un interlocuteur complet. En politique, l’idée peut sembler « efficace »: plus de refus de débat, plus de contradictions imprévues, seulement une version synthétique de l’opposant, façonnée par un modèle d’IA qui répond sur commande. Mais cette facilité pose des questions lourdes: est-ce encore un débat? où commence la désinformation? et quel message envoie-t-on aux électeurs sur la valeur d’un échange réel?

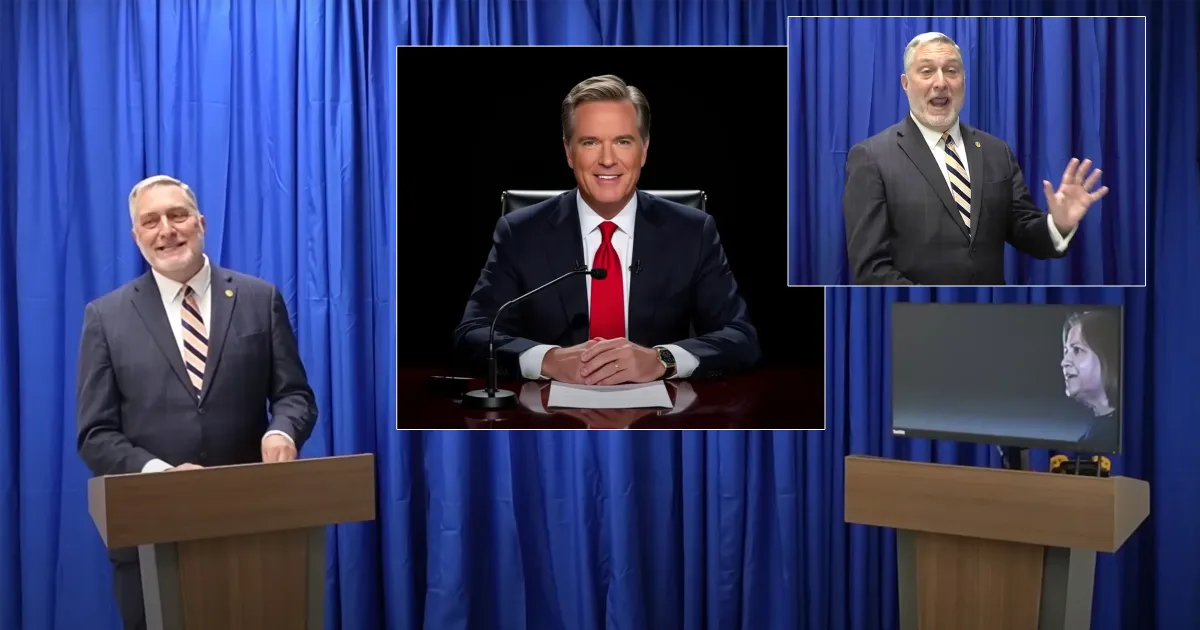

La mise en scène inédite de John Reid

- Le candidat républicain à la vice-gouvernance de Virginie, John Reid, a diffusé un long échange filmé dans lequel il dialogue avec une version générée par IA de sa rivale démocrate, la sénatrice Ghazala F. Hashmi.

- Il explique au préalable que sa concurrente aurait refusé plusieurs invitations à débattre, d’où son « plan B »: recréer une Hashmi numérique, assortie d’un modérateur IA à la voix monocorde.

- L’apparat du débat est là: pupitres, cadrages larges, répliques alternées. Sauf que l’« adversaire » n’est qu’un écran dictant des réponses prévisibles. Résultat: Reid enchaîne les passes faciles, et la scène vire au théâtre politique plus qu’à une confrontation d’idées.

Réactions et climat politique

L’épisode illustre une période où la politique américaine devient, au sens propre, étrange. Des stratèges locaux soulignent que ce n’est pas si éloigné d’autres usages tapageurs de l’IA déjà visibles dans l’espace public, où des vidéos grossières mais virales servent à railler les opposants. Dans ce brouhaha visuel, les frontières entre satire, propagande et intox se brouillent, tandis que l’audience peine à distinguer l’absurde du crédible.

Quand les deepfakes s’attaquent au vote

Le cas Reid n’est pas isolé. Au même moment, un deepfake attribué à la candidate à la présidence irlandaise Catherine Connolly a circulé pour annoncer à tort son « retrait » de la course. La véritable candidate a dénoncé une tentative de tromper les électeurs et d’affaiblir la démocratie. L’incident rappelle que quelques secondes de vidéo falsifiée peuvent suffire à semer le doute à un moment critique d’une campagne.

Pourquoi cela nous concerne tous

- Les outils s’améliorent vite. Sans normes ni règles claires, l’usage politique de l’IA risque d’être plus sophistiqué et plus fréquent dès les prochaines échéances électorales.

- Le coût de fabrication chute, la diffusion est instantanée, et la correction arrive souvent trop tard.

- Entre efficacité médiatique et responsabilité civique, les acteurs publics vont devoir trancher: transparence, mentions obligatoires, garde-fous techniques, et éducation du public deviennent des priorités urgentes.

En bref

- Un candidat de Virginie a débattu avec un avatar IA de son adversaire.

- L’exercice, spectaculaire, souligne l’emprise croissante de l’IA générative en politique.

- Les deepfakes s’invitent déjà dans des campagnes étrangères, avec des tentatives de manipulation du vote.

- Sans cadre commun, on s’expose à une normalisation de la désinformation automatisée.

À suivre

Dans le même paysage technologique, la filière IA traverse des ajustements rapides: après une phase d’embauches massives, des informations de presse évoquent des réductions d’effectifs chez des géants du secteur. Le rythme de ces retournements illustre la course actuelle entre ambitions, coûts et résultats tangibles.

FAQ

Qu’est-ce qu’un deepfake, concrètement ?

C’est un contenu audio ou vidéo synthétique créé via des modèles d’IA capables d’imiter une voix, un visage ou des gestes. Avec des données d’entraînement suffisantes, on peut produire des séquences très convaincantes, parfois indétectables à l’œil nu.

Est-il légal d’utiliser un deepfake en campagne électorale ?

Cela dépend des juridictions. Certaines imposent des disclosures (mention claire qu’il s’agit d’un contenu généré), d’autres répriment l’usurpation d’identité, la diffamation ou la tromperie des électeurs. Le cadre se durcit, mais reste fragmenté.

Comment repérer une vidéo suspecte ?

- Chercher l’origine du contenu et des sources fiables.

- Observer les détails: clignements irréguliers, synchronisation labiale étrange, artéfacts audio.

- Vérifier s’il existe un démenti officiel ou des analyses de vérificateurs indépendants.

Que peuvent faire les plateformes ?

Elles peuvent appliquer des étiquettes aux contenus générés, détecter l’empreinte de synthèse, ralentir la viralité suspecte, et offrir des outils de signalement plus visibles en période électorale.

Quelles règles utiles adopter rapidement ?

- Mention obligatoire pour tout contenu généré ou altéré.

- Archivage public des originaux de campagne.

- Tests indépendants des outils de détection.

- Sanctions graduées contre la manipulation intentionnelle en contexte électoral.