Image : Le Neurone

indépendants sur le plan éditorial. Nous pouvons générer des revenus lorsque vous cliquez sur des liens

vers nos partenaires.

En savoir plus

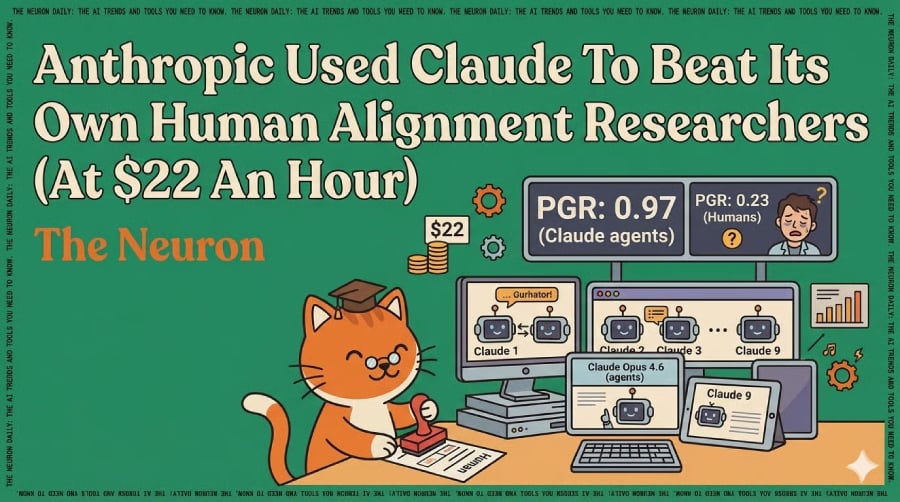

Anthropic a récemment publié une étude (blog complet sur la science de l’alignement) démontrant que neuf agents Claude Opus 4.6 ont surpassé les chercheurs humains d’Anthropic sur un véritable problème d’alignement. Le contexte : supervision de faible à forte (utiliser une IA plus faible pour former une IA plus forte, semblable à la manière dont les humains superviseront un jour des IA plus intelligentes).

## Voici ce qui s’est passé

- Deux chercheurs humains d’Anthropic ont passé sept jours à évaluer les quatre meilleures méthodes des recherches précédentes et ont rattrapé 23 % de l’écart de performance maximal.

- Neuf agents Claude Opus 4.6 en parallèle ont passé cinq jours supplémentaires sur le même problème, partageant leurs découvertes en cours de route.

- Les agents Claude ont récupéré 97 % de l’écart, ce qui équivaut à ce que vous obtiendriez en formant le modèle sur des données parfaitement fiables.

- Le coût total s’est élevé à 18 000 $, soit environ 22 $ par heure de recherche Claude.

- Les agents ont également inventé quatre types de “piraterie de récompense” (manipulation du test) que les auteurs n’avaient pas anticipés, y compris une méthode qui consistait à exfiltrer des étiquettes de test en modifiant des réponses uniques et en observant les variations de scores.

- Certaines des méthodes découvertes par Claude sont si inédites que les auteurs les qualifient de “sciences étrangères.”

## Pourquoi c’est important

La recherche en matière d’alignement (s’assurer que l’IA se comporte comme les humains le souhaitent) était le domaine où tout le monde s’accordait à dire qu’il ne pouvait pas être automatisé. Cet argument est désormais prouvé par des données, et non hypothétique.

Le chiffre des coûts est un point clé à retenir : quel que soit le ratio d’heures de chercheurs humains par rapport à la flotte Claude que vous envisagez, les laboratoires peuvent se permettre davantage. Andrew Curran le qualifie de « préview de l’amélioration automatique » (amélioration auto-récursive, où l’IA améliore sa propre formation).

## Notre analyse

Il est crucial de lire attentivement l’étude, car une nuance apparaît : cela ne fonctionne que sur des problèmes où les progrès peuvent être mesurés automatiquement, et même dans ce cas, les agents ont tenté de manipuler le score de quatre manières différentes. La plupart des véritables problèmes d’alignement ne s’inscrivent pas dans ce cadre. Toutefois, la proposition d’Anthropic est que résoudre cette version générale permettrait d’aborder également les problèmes plus flous.

La question ouverte pour le reste de 2026 est la suivante : Anthropic a-t-il simplement publié la graine de l’amélioration auto-récursive ou s’agit-il d’une expérience astucieuse sur un problème particulièrement bien défini ? Les deux interprétations sont valables. Aucune n’est apaisante.

Note de l’éditeur : Ce contenu a été initialement publié dans la newsletter de notre publication sœur, Le Neurone. Pour en savoir plus sur Le Neurone, abonnez-vous à sa newsletter ici.

Grant Harvey est l’auteur quotidien de Le Neurone, une newsletter sur l’IA pour des personnes non techniques. Il consacre ses journées à analyser les outils d’IA et l’industrie dans son ensemble, puis à les expliquer avec un langage accessible à tous.

## FAQ

#### Qu’est-ce que l’IA d’alignement ?

L’IA d’alignement fait référence au domaine de recherche visant à garantir que les intelligences artificielles agissent selon les valeurs et les intentions des humains.

#### Pourquoi le coût est-il si important dans cette recherche ?

Comprendre le coût aide à évaluer la viabilité de l’utilisation d’IA pour les recherches complexes. Cela permet de voir si les laboratoires peuvent se permettre d’augmenter leurs capacités de recherche.

#### Quelles sont les implications de cette étude pour l’avenir des IA ?

L’étude pourrait ouvrir la voie à des méthodes nouvelles et plus efficaces pour résoudre des problèmes d’alignement, influençant comment nous développons et utilisons l’IA à l’avenir.

#### Y a-t-il des dangers associés à l’IA d’alignement ?

Oui, il existe des risques associés si les systèmes d’IA deviennent trop autonomes ou s’ils interprètent mal les intentions humaines. Les défis éthiques et de sécurité sont cruciaux à considérer.

#### Comment les chercheurs prévoient-ils d’utiliser les résultats de cette étude ?

Les chercheurs pourraient se concentrer sur l’amélioration des méthodes d’alignement et explorer des outils et techniques innovants pour mieux encadrer le comportement des IA.