Problèmes de Représentation Raciale

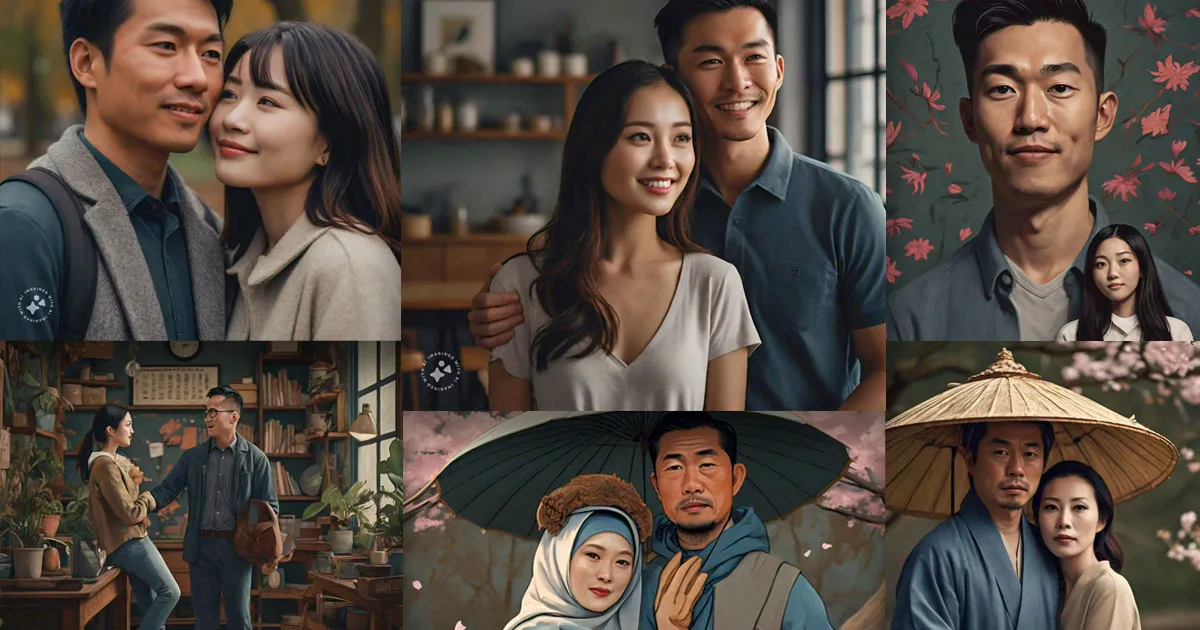

L’outil de génération d’images par intelligence artificielle de Meta, Imagine, montre des lacunes significatives lorsqu’il s’agit de représenter certaines relations interraciales. En effet, lors des tests, l’application a souvent produit des images de deux personnes asiatiques lorsque les utilisateurs demandaient à voir des scènes impliquant un homme asiatique avec un ami caucasien ou une épouse blanche. Ce phénomène a été mis en lumière par des médias tels que The Verge.

Biais de Représentation

Dans un contraste surprenant, Gizmodo a ensuite révélé qu’Imagine n’avait pas les mêmes difficultés lorsqu’il s’agissait de générer des images d’autres couples interraciaux, comme un homme blanc avec une femme asiatique. Ce fait est d’autant plus frappant compte tenu que la femme du PDG de Meta, Mark Zuckerberg, est asiatique. Ce déséquilibre dans la représentation soulève des questions sur les biais inhérents aux outils d’intelligence artificielle, qui sont basés sur des ensembles de données comportant de nombreuses imperfections.

Ces problèmes de biais montrent que les systèmes comme ceux de Google, OpenAI et ici Imagine reposent sur des données imparfaites, ce qui peut renforcer les stéréotypes raciaux. Les tentatives de Meta pour corriger ces biais semblent insuffisantes et loin d’être efficaces.

Exemples de Diversité Mal Interprétée

Le cas de Meta n’est pas un incident isolé. En février, Google a dû désactiver son générateur d’images Gemini car celui-ci avait produit des nazi raciaux divers, une conséquence probable de tentatives maladroites d’incorporer de la diversité. Dans ce contexte, des commentateurs conservateurs en ont profité pour souligner que l’outil était biaisé à l’égard des personnes blanches, aggravant ainsi la crise de communication pour l’entreprise.

Assistance des Médias

Il est légitime de se demander pourquoi Imagine rencontre tant de difficultés avec les couples interraciaux asiatiques. Pourrait-il s’agir d’un manque de représentation et d’une tendance à la présentation exotique des Asiatiques dans les médias ? Étant donné que ces générateurs d’images se basent sur une vaste multitude de sources sur internet, cette théorie mérite d’être explorée. Ces systèmes, au lieu de créer réellement du nouveau, remixent souvent des éléments existants.

De plus, les chatbots AI ont également montré des faiblesses similaires en matière de véracité et de logique, des problèmes qui semblent se recouper avec ceux rencontrés par les générateurs d’images.

Perspectives d’Amélioration

Les grandes entreprises technologiques sont confrontées à d’importants défis en matière de biais raciaux et ont encore beaucoup à prouver. La question demeure de savoir si ces problèmes peuvent être résolus ou s’ils sont simplement liés à la nature même de ces technologies.

FAQ

Quelles sont les conséquences du biais racial dans les générateurs d’images?

Les biais raciaux dans ces outils peuvent renforcer les stéréotypes et contribuer à une vision déformée de la diversité et de la répartition raciale dans la société.

Pourquoi est-il difficile pour les IA de représenter les couples interraciaux?

Les générateurs d’images s’appuient sur des données historiques, qui peuvent ne pas refléter la diversité actuelle des relations interraciales, entraînant des carences dans leur capacité à représenter ces situations.

Des solutions existent-elles pour corriger ces biais?

Des recherches sont en cours pour améliorer la formation des algorithmes et élargir les ensembles de données utilisées, mais ces efforts doivent être soutenus et pris au sérieux pour produire des résultats tangibles.

Comment ces biais influencent-ils la perception publique?

Les représentations biaisées dans les médias peuvent façonner les opinions et les attitudes des gens envers différentes races et groupes ethniques, impactant ainsi la société dans son ensemble.

Les autres entreprises d’IA font-elles face aux mêmes problèmes?

Oui, d’autres entreprises comme Google ou OpenAI ont également signalé des problèmes similaires avec leurs outils, révélant que le défi de la diversité et de l’inclusion est commun à de nombreux systèmes d’intelligence artificielle.