En savoir plus

La Californie renforce les critères pour la vente d’IA à l’État

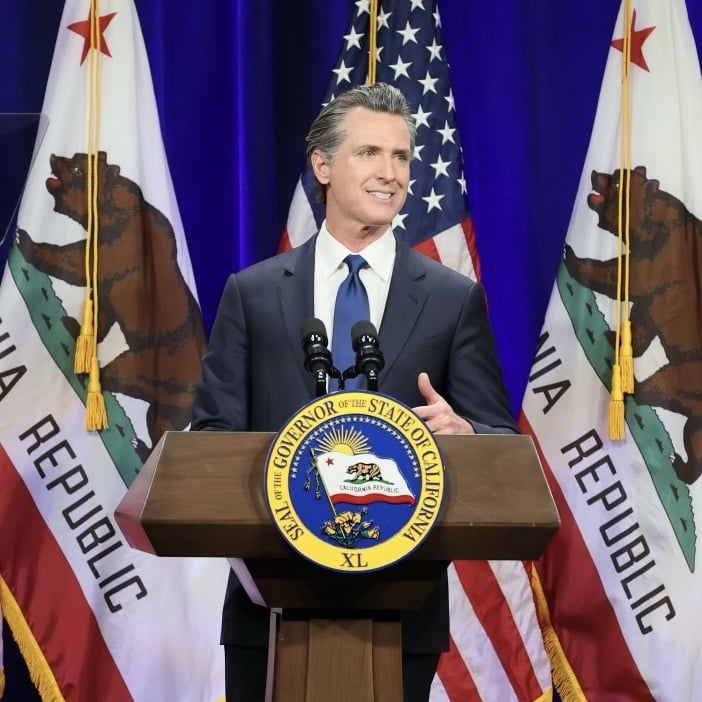

La Californie prend des mesures pour encadrer la vente de technologies d’intelligence artificielle (IA) à son gouvernement. Dans un communiqué de presse daté du 30 mars, le gouverneur Gavin Newsom a introduit un nouvel ordre exécutif qui associe les contrats d’IA de l’État à des garanties publiques concernant la protection de la vie privée, les droits civiques et la lutte contre les biais.

Cette initiative vise à accroître l’utilisation de l’IA au sein des services publics californiens, établissant ainsi un cadre plus sécurisant pour intégrer ces technologies.

Les fournisseurs d’IA devront justifier leurs dispositifs de sécurité

L’ordre exécutif impose aux agences étatiques un délai de 120 jours pour formuler des recommandations sur de nouvelles certifications à intégrer dans le processus de passation de marchés pour les entreprises d’IA désireuses de faire affaire avec l’État. Ces fournisseurs devront potentiellement attester de leurs mesures de sécurité et expliquer le fonctionnement de celles-ci.

Cet ordre précise clairement les aspects que la Californie souhaite examiner :

- Contenu illégal, y compris des matériel portant atteinte à des mineurs ou des images intimes sans consentement.

- Biais nuisibles et gouvernance laxiste concernant ces risques.

- Problèmes liés aux droits civiques et libertés, tels que la liberté d’expression, le droit de vote, la discrimination, la détention et la surveillance.

La Californie met en place un processus d’évaluation qui dépasse les simples promesses des produits avant qu’un outil IA ne soit utilisé dans les services publics.

Des critères plus stricts pour certaines entreprises

Un autre aspect de cette initiative s’intéresse à l’entreprise derrière le système d’IA. Newsom souhaite des recommandations sur la poursuite de la collaboration avec des sociétés ayant été reconnues par des tribunaux pour des violations des droits à la vie privée ou aux libertés civiles.

Le passé judiciaire d’un fournisseur pourrait donc avoir son importance lors de l’évaluation de sa capacité à fournir des outils d’IA à l’État.

Un autre point à noter vient de Washington : si le gouvernement fédéral qualifie une entreprise de risque pour la chaîne d’approvisionnement, le responsable de la sécurité informatique de Californie devra examiner cette qualification. Les agences pourraient être encouragées à continuer leurs achats auprès de cette entreprise si l’État estime que la décision fédérale est inappropriée.

Une plus grande intégration de l’IA générative

Les citoyens cherchant un soutien en cas de catastrophe, désireux de créer leur propre société ou à la recherche d’un emploi pourraient bénéficier de cet ordre à travers une nouvelle application ou un site web développé par l’État. Newsom a proposé la création d’un outil permettant de centraliser les services publics en fonction des événements de la vie, offrant ainsi aux Californiens un accès plus direct à l’aide.

Au sein de la fonction publique, les employés devraient avoir un accès élargi à des outils d’IA générative rigoureusement sélectionnés pour leurs tâches courantes, tout en intégrant des mesures de protection de la vie privée et de cybersécurité. Les agences sont également invitées à partager leurs meilleures pratiques au sein des groupes étatiques.

D’autres travaux sont également envisagés, tels qu’une formation étendue sur les technologies émergentes et l’IA, ainsi qu’un kit d’outils de minimisation des données destiné aux services traitant des informations sensibles. Ce kit comprendra des modèles, des dispositions contractuelles et des listes de contrôle pour assurer la conformité.

Le département technologique de Californie est également chargé de développer des directives concernant l’hachage des images et vidéos générées par l’IA ou ayant subi une modification significative, conformément à la législation en vigueur.

Newsom, un contrepoint à Washington

Newsom a profité de cette annonce pour établir un contraste direct avec Washington, accusant le gouvernement fédéral de relâcher les normes et protections, alors que la Californie souhaite renforcer celles relatives à la vie privée, à la sécurité et aux droits civiques.

La Californie souhaite poursuivre l’intégration de l’IA dans ses institutions, mais sous des règles que Newsom présente comme plus strictes que celles proposées au niveau fédéral.

Une pression bipartisane à Washington pourrait faire de robots fabriqués en Chine la prochaine cible des mesures de sécurité technologique aux États-Unis.

FAQ

Quelles seront les prochaines étapes après l’ordre exécutif ?

Après l’expiration du délai de 120 jours, les agences fourniront des recommandations sur les certifications nécessaires, influençant ainsi le futur des contrats d’IA en Californie.

Comment cet ordre exécutif affecte-t-il les citoyens ?

Cet ordre vise à protéger les citoyens du biais et des atteintes à la vie privée dans l’utilisation de l’IA, tout en facilitant leur accès aux services publics.

L’ordre concerne-t-il les organisations à but non lucratif également ?

Oui, les organisations à but non lucratif souhaitant offrir des services via des outils d’IA devront également se conformer à ces nouvelles exigences.

Quelles mesures sont prises pour la protection des données ?

Le gouvernement de Californie mettra en place des protocoles de sécurité et des vérifications pour garantir que les données sensibles soient traitées de manière appropriée et sécurisée.

Comment les entreprises peuvent-elles se préparer à ces changements ?

Les entreprises d’IA doivent évaluer leurs pratiques en matière de protection de la vie privée et de conformité aux standards énoncés dans l’ordre pour rester éligibles aux contrats avec l’État.