Image : The Neuron

éditorialement indépendants. Nous pouvons générer des revenus lorsque vous cliquez sur les liens de nos partenaires.

En savoir plus

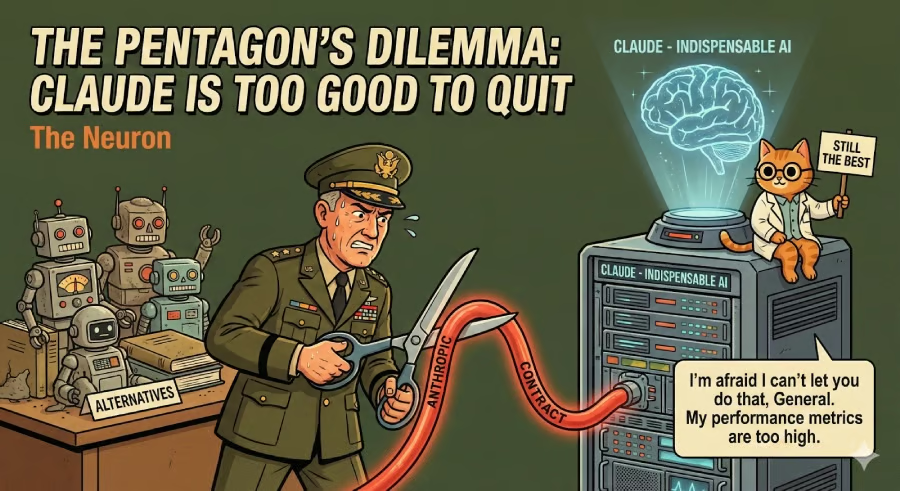

Voici une affirmation surprenante : le gouvernement américain menace de sanctionner une entreprise d’IA pour son éthique jugée trop rigoureuse.

Selon un rapport d’Axios, le secrétaire à la Défense, Pete Hegseth, envisagerait de couper les ponts avec **Anthropic**, en la désignant comme un **risque pour la chaîne d’approvisionnement**, un qualificatif habituellement attribué à des adversaires étrangers, comme les entreprises technologiques chinoises. Cette décision s’explique par le refus d’Anthropic de donner au Pentagone une permission générale pour utiliser leur modèle Claude à des fins **légales**.

Les deux conditions non négociables d’Anthropic sont les suivantes : pas de surveillance massive des citoyens américains et pas d’armement autonome sans intervention humaine.

Un officiel du Pentagone a déclaré : « Nous allons veiller à ce qu’ils en subissent les conséquences pour avoir agi ainsi. »

Ce qui rend la situation incroyable

- Claude est l’unique modèle d’IA actuellement utilisé dans les systèmes classifiés de l’armée.

- Ce modèle a été utilisé lors de l’opération contre Maduro en janvier dernier.

- Les responsables du Pentagone font publiquement l’éloge de ses capacités.

- Le contrat en question pourrait atteindre jusqu’à **200 millions de dollars**, une goutte d’eau comparée aux **14 milliards de dollars** de revenus annuels d’Anthropic.

- Cependant, le véritable danger réside dans l’étiquetage de la **chaîne d’approvisionnement**, qui obligerait toute entreprise collaborant avec le Pentagone à prouver qu’elle ne utilise pas Claude, risquant d’exclure Claude de plateformes comme Microsoft Copilot, par exemple.

- Cela est crucial, car 8 des 10 plus grandes entreprises américaines utilisent déjà ce modèle.

Pendant ce temps, **OpenAI**, **Google** et **xAI** ont accepté de réduire leurs mesures de sécurité pour une utilisation militaire sur des systèmes non classifiés. Anthropic est la seule entreprise à rester ferme sur ses positions.

La réaction sur **Reddit** a été rapide et presque unanime en faveur d’Anthropic :

- Commentaire le plus populaire sur r/ClaudeAI : « C’est un argument de vente. Transformez-le en publicité. »

- Plusieurs utilisateurs ont mentionné qu’ils envisageaient de **mettre à jour leurs abonnements** pour soutenir Anthropic.

- Un contractant de la défense a souligné que de nombreuses entreprises préféraient abandonner leurs contrats gouvernementaux plutôt que de se séparer de Claude, car les coûts de conformité ne valent pas la peine.

L’ironie est impossible à ignorer

Si un autre modèle avait les mêmes capacités, le Pentagone aurait simplement changé de fournisseur. La menace de sanction, au lieu d’une rupture, représente probablement l’une des plus grandes considérations en faveur de Claude.

Un utilisateur de Reddit l’a bien formulé : « Cet article est comme une **panneau publicitaire** pour Anthropic. ‘Nous sommes si bons que le Pentagone ne peut pas nous remplacer, même quand ils le souhaitent.’ »

D’un autre côté, le temps joue contre Anthropic, car les développeurs priorisent **Codex** plutôt qu’**Opus** après que l’entreprise ait commis une série d’erreurs stratégiques :

- D’abord, ils ont opté pour une **poursuite** au lieu d’une **négociation** avec le créateur de **OpenClaw** à cause de son précédent nom, **Clawdbot**, ce qui leur a fait perdre une opportunité d’embauche.

- Les publicités du **Super Bowl** ont été classées parmi les **3% les moins appréciées** par le grand public, bien qu’elles aient provoqué une augmentation de 11% des utilisateurs parmi ceux qui ont compris l’humour.

- Les mouvements de l’entreprise ont érodé la confiance des développeurs, en raison de sa politique sur l’utilisation de **Claude Code** dans d’autres outils et en étant en général perçue comme un modèle d’IA à **prix premium**.

Que dire de plus ? Il semble qu’Anthropic se positionne comme l’entreprise d’IA qui n’a finalement pas besoin de partenaires. Reste à voir si cette stratégie porte ses fruits…

Remarque de l’éditeur : Ce contenu a été publié à l’origine dans la lettre d’ADGO.ca, The Neuron. Pour lire plus d’articles de The Neuron, inscrivez-vous à sa newsletter ici.

**Grant Harvey** est le rédacteur quotidien de **The Neuron**, une newsletter sur l’IA d’ADGO.ca destinée aux personnes non techniques. Son travail consiste à analyser les outils d’IA et l’industrie dans son ensemble, puis à les expliquer dans un langage accessible à tous.

FAQ

Qu’est-ce qu’Anthropic ?

Anthropic est une entreprise spécialisée dans le développement d’intelligences artificielles, mettant l’accent sur des pratiques éthiques et responsables.

Pourquoi le Pentagone veut-il sanctionner Anthropic ?

Les autorités veulent sanctionner Anthropic parce que l’entreprise refuse de donner au Pentagone une autorisation sans condition pour utiliser son modèle d’IA, Claude.

Quelles sont les préoccupations éthiques d’Anthropic ?

Anthropic se refuse à permettre la surveillance de masse des Américains et l’utilisation d’armes autonomes, citant des préoccupations éthiques sur l’impact de ces technologies.

Quel impact pourrait avoir l’étiquetage de risque pour la chaîne d’approvisionnement ?

Cet étiquetage pourrait contraindre les entreprises à prouver qu’elles ne collaborent pas avec Claude, ce qui pourrait réduire l’utilisation de ce modèle parmi les plus grandes sociétés américaines.

Quelle a été la réaction du public face aux nouvelles de ces menaces ?

La réaction majoritaire sur les plateformes comme Reddit a été largement en faveur d’Anthropic, avec des utilisateurs qui déclarent vouloir soutenir l’entreprise en améliorant leurs abonnements.