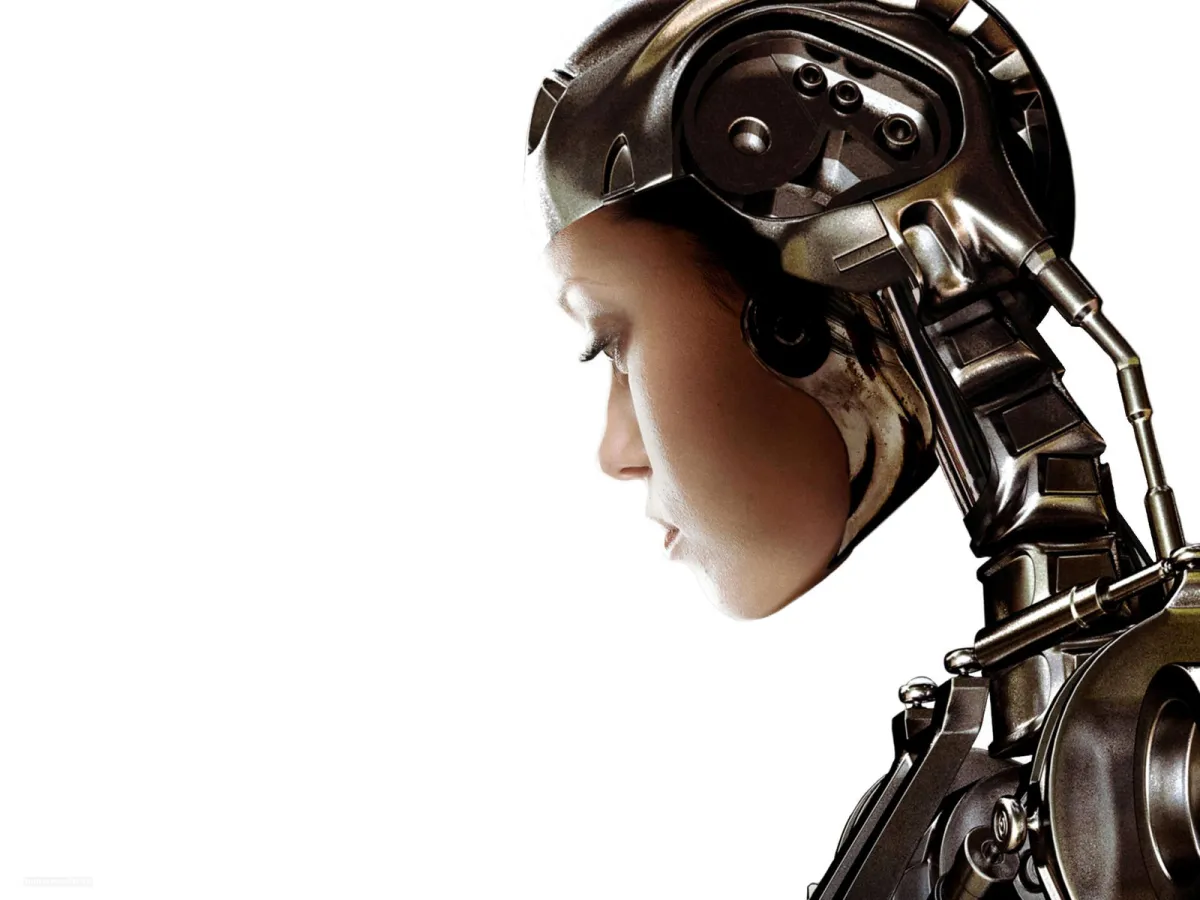

Le débat sur les armes autonomes : une nécessité de régulation

Il est essentiel de ne pas se lancer dans le développement de n’importe quelle technologie simplement parce qu’elle est disponible. Des penseurs, des scientifiques et des figures de proue contemporaines prennent position pour instaurer des restrictions strictes sur l’innovation, en particulier dans le domaine des robots. Ils soulignent la nécessité de réguler les avancées technologiques dans une lettre ouverte demandant l’interdiction des armes autonomes, publiée le 28 juillet 2015, et soutenue par des milliers de signatures.

Une distinction importante

Il existe une différence marquante entre les technologies totalement sous le contrôle humain, comme les drones pilotés, et les robots intelligents qui prennent des décisions de façon autonome concernant leurs cibles. Beaucoup d’experts estiment que ces derniers ne devraient pas être soutenus, ni même tolérés.

Personnalités éminentes telles que Stephen Hawking, Elon Musk, et d’autres ont signé cette lettre, relayée par le Future of Life Institute. Ce groupe de signataires est représentatif de préoccupations communes concernant les risques associés à l’intelligence artificielle dans des contextes militaires, évoquant des craintes sur une potentielle course aux armements.

Des inquiétudes légitimes

De nombreux experts s’inquiètent que ces armes pourraient tomber entre de mauvaises mains, créant ainsi une situation où des terroristes ou des individus au comportement imprévisible pourraient facilement acquérir une telle technologie. En parallèle, certains médias amplifient les peurs en affant que les robots pourraient un jour dominer le monde, un scénario qui, en réalité, n’est pas ce que soulèvent les signataires de la lettre.

L’enjeu est surtout la peur d’une course aux armements où les nations se précipitent pour développer ces technologies, risquant d’entraîner un climat de tension semblable à celui de la Guerre froide.

Risques et conséquences

Les signataires avertissent que si une grande puissance militaire se lance dans le développement d’armes AI, cela pourrait déclencher une dynamique inévitable d’escalade. Les armes autonomes pourraient devenir aussi accessibles que les Kalachnikovs à l’ère actuelle, facilitant leur production massive et rendant ainsi leur usage plus fréquent.

Conséquences sur la sécurité mondiale

Le véritable danger ne réside pas dans une compétition froide pour développer les robots les plus mortels, mais plutôt dans le risque que des entités malveillantes puissent facilement obtenir ces technologies. Des armes autonomes pourraient être utilisées pour des objectifs tels que l’assassinat, la déstabilisation des États ou même des actes de purification ethnique. Pour cette raison, un éventuel développement de l’IA dans un contexte militaire est jugé désastreux pour l’humanité.

Un appel à la responsabilité

La lettre incite également les professionnels du secteur de l’intelligence artificielle à prendre une position claire contre cette évolution. La science derrière l’IA doit être dirigée de manière éthique, et ces experts doivent agir comme des guides moraux, afin d’éviter que leur domaine soit terni par les conséquences de développements irresponsables.

L’importance d’un consensus

Historiquement, des scientifiques dans d’autres disciplines, comme la chimie et la biologie, ont soutenu des accords internationaux pour interdire des armes chimiques ou biologiques. De la même manière, les chercheurs en IA doivent plaider pour l’interdiction des armes autonomes, afin de ne pas compromettre les bénéfices sociétaux que cette technologie pourrait offrir.

Conclusions

Il est clair que l’IA a un potentiel énorme pour améliorer notre société, mais engager le développement des armes autonomes serait une décision largement vouée à l’échec. Une approche prudente et réfléchie est primordiale pour garantir un avenir où la technologie sert l’humanité, et non l’inverse. Il est donc impératif de réfléchir et d’agir avec prudence.

L’avenir dans deux décennies sera assurément très différent de ce que nous connaissons aujourd’hui. Par conséquent, il est crucial de progresser avec précaution, en mesurant les conséquences potentielles de chaque avancée technologique.

FAQ

Qu’est-ce qui déclenche la peur liée aux armes autonomes ?

Les craintes proviennent de la possibilité que des armes contrôlées par l’IA pourraient être utilisées à des fins malveillantes, notamment par des groupes terroristes.

Qui sont les principaux signataires de la lettre ouverte contre les armes autonomes ?

Des figures telles que Stephen Hawking, Elon Musk, Daniel Dennett, et Steve Wozniak figurent parmi les signataires.

Comment l’intelligence artificielle peut-elle améliorer la sécurité sans créer d’armes ?

L’IA peut être utilisée pour des technologies visant à minimiser les pertes humaines et à faciliter la sécurité publique sans recourir à des dispositifs destructeurs.

Existe-t-il des précédents historiques pour interdire les technologies de guerre ?

Oui, des accords ont été établis pour interdire l’utilisation d’armes chimiques et biologiques, ainsi que certains types d’armements nucléaires.

Quel rôle peuvent jouer les chercheurs en IA dans ce débat ?

Les chercheurs doivent promouvoir une utilisation éthique de l’IA et s’opposer fermement au développement d’armes autonomes, agissant ainsi comme des défenseurs de leur discipline.