Une alliance qui fait débat

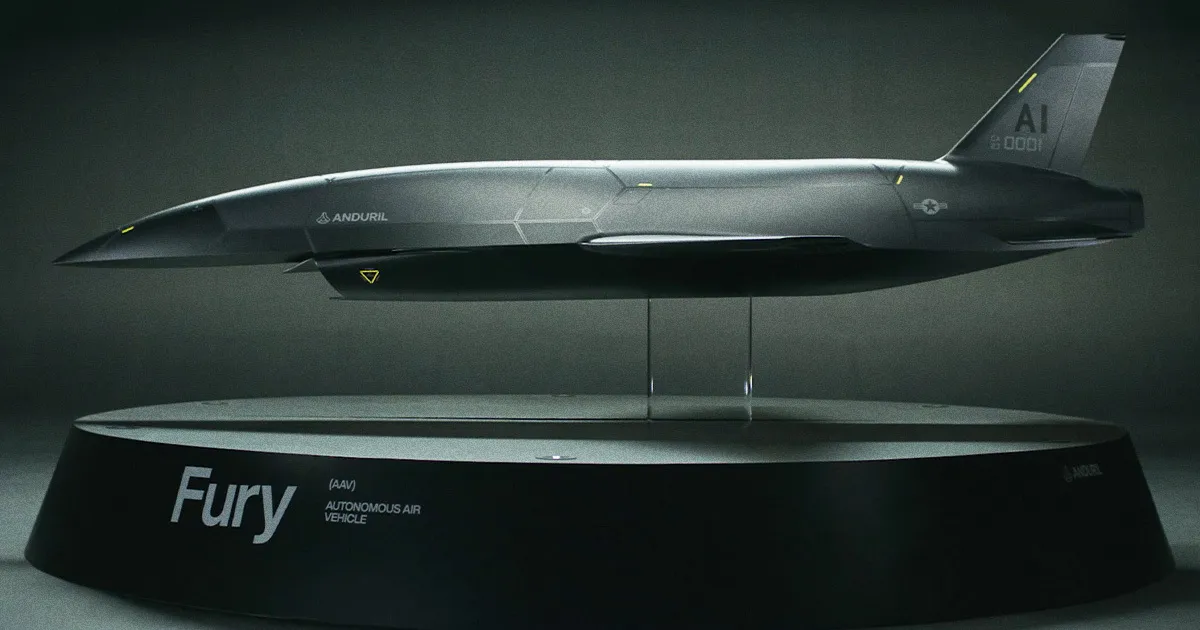

L’éditeur d’IA OpenAI s’associe au groupe de défense Anduril, connu pour ses drones en essaim capables d’opérations offensives et de systèmes anti-drones. L’accord est présenté comme un moyen de renforcer la sécurité et de défendre des valeurs démocratiques, mais il soulève des interrogations évidentes: quand l’IA alimente des technologies militaires, où placer la limite entre usage défensif et capacité d’attaque?

De quoi s’agit-il concrètement ?

Selon les déclarations publiques, OpenAI mettra ses modèles d’IA au service d’Anduril pour améliorer l’analyse de menaces aériennes, accélérer la détection et la prise de décision sur le terrain, et aider des opérateurs à agir plus vite sous forte pression. L’idée officielle: réduire les risques pour le personnel militaire en fournissant de meilleures informations en temps réel.

La communication des deux entreprises

- Côté OpenAI, la direction souligne vouloir que l’IA serve le plus grand nombre, en appui d’initiatives menées par les États-Unis pour préserver des valeurs démocratiques. L’entreprise insiste sur des usages «responsables» et une finalité de protection.

- Côté Anduril, le message est similaire: les systèmes doivent aider des opérateurs militaires et de renseignement à prendre des décisions plus rapides et plus précises. En clair, rendre les défenses aériennes plus intelligentes et plus réactives face à des drones de combat déjà éprouvés sur des théâtres modernes.

Un virage discret, mais réel, dans la politique d’OpenAI

Pendant longtemps, OpenAI interdisait l’usage de ses modèles pour des finalités militaires, la guerre ou la conception d’armes. Début 2024, cette ligne s’est assouplie: la société a commencé à fournir des outils de cybersécurité au Pentagone, signe tangible d’une ouverture vers la défense. D’après des témoignages rapportés par la presse spécialisée, cette évolution a laissé certains employés réticents, sans provoquer de contestation publique d’ampleur.

La position officielle actuelle

OpenAI affirme que la coopération avec Anduril reste compatible avec ses politiques d’usage et qu’elle n’a pas pour but de «concevoir des systèmes destinés à nuire». Dans les faits, une fois les technologies intégrées aux plateformes de défense, l’entreprise se trouve bel et bien impliquée dans un écosystème militaire — même si l’intention affichée est la protection et la défense.

La frontière floue entre «défense» et «offensive»

Aider une société qui commercialise des drones d’attaque à mieux fonctionner peut ressembler à un contournement des promesses de ne pas permettre de faire du mal. La ligne de partage est ténue: un même algorithme peut servir à neutraliser un engin hostile ou à optimiser une frappe. Cette ambiguïté nourrit la critique: parler de «défense» ne suffit pas à garantir que l’IA ne renforce pas aussi des capacités offensives.

Les implications éthiques et pratiques

- La rapidité décisionnelle promise par l’IA peut réduire des erreurs humaines, mais elle peut aussi accélérer des chaînes d’action à haut risque.

- Les engagements de «responsabilité» et de «contrôle humain» doivent être traduits en mécanismes concrets: auditabilité, traçabilité des décisions, et limites d’emploi claires.

- Dans un contexte de conflits où les drones jouent un rôle croissant, cette alliance contribue à la militarisation de l’IA, un mouvement qui s’intensifie partout dans le monde.

Pourquoi cette alliance compte

Au-delà de l’annonce, il s’agit d’un test pour la gouvernance de l’IA dans des secteurs sensibles. Les choix d’OpenAI influencent non seulement ses utilisateurs et ses partenaires, mais aussi la façon dont l’industrie toute entière abordera les restrictions d’usage, l’encadrement réglementaire et la transparence. Les prochains mois diront si les garde-fous promis sont réels ou s’ils restent au niveau du discours.

Points à surveiller

- Des limites d’usage explicitement défensives, vérifiables par audit indépendant.

- La présence obligatoire d’un humain dans la boucle pour les décisions critiques.

- Des mécanismes de journalisation permettant d’analyser a posteriori chaque décision algorithmique.

- La gestion des données sensibles et la prévention des détournements d’usage.

- Un contrôle externe (régulateurs, experts) capable d’évaluer l’impact réel des systèmes déployés.

FAQ

Qu’est-ce qu’un «essaim» de drones au juste ?

Un essaim regroupe de nombreux drones autonomes coordonnés. Ils partagent des informations et s’adaptent entre eux, ce qui les rend plus résilients et difficiles à contrer qu’un drone isolé.

Que signifie «humain dans la boucle» dans ce contexte ?

C’est l’exigence que des opérateurs humains valident les décisions à fort impact (par exemple, l’identification de menaces ou l’activation d’effets), plutôt que de laisser l’IA agir seule.

Comment les entreprises distinguent-elles «défensif» et «offensif» ?

Elles s’appuient sur des politiques d’usage, des clauses contractuelles et des paramétrages qui limitent les fonctions disponibles (détection, brouillage, interception) sans fournir de capacités d’attaque directe. En pratique, la frontière reste complexe à maintenir.

Quels garde-fous supplémentaires seraient utiles ?

Des tests de sécurité indépendants, des audits réguliers, des listes d’interdictions claires (cibles, zones, modes d’emploi), et des interrupteurs techniques empêchant l’escalade automatique sans validation humaine.

Est-ce un mouvement isolé dans l’industrie ?

Non. De plus en plus d’acteurs de la tech collaborent avec la défense pour des outils de cybersécurité, de surveillance et de contre-drones. Le débat porte désormais sur la manière de rendre ces déploiements réellement responsables.