Un chien robot armé déclenche une controverse mondiale

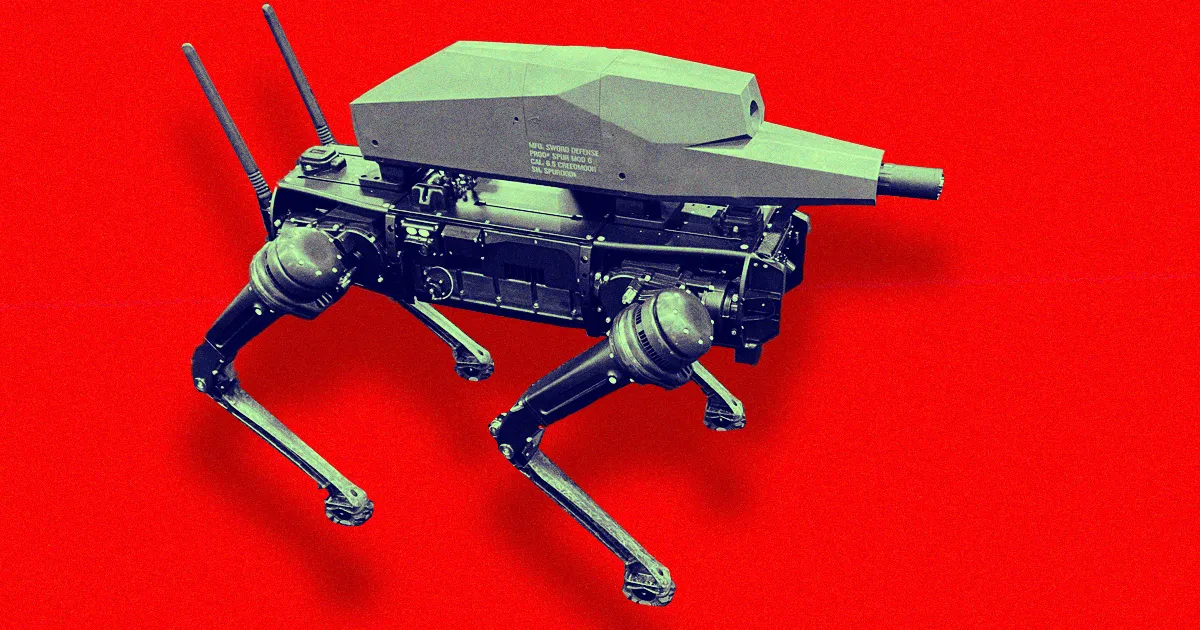

Un prototype de quadrupède robotique de Ghost Robotics a été présenté avec un fusil de précision fixé sur le dos. Les images de cette machine — un modèle Q-UGV — ont circulé largement et relancé un débat brûlant: faut‑il permettre à des robots terrestres d’être armés, et jusqu’où? L’arme utilisée, conçue par SWORD International, revendique une portée d’environ 1,2 km, ce qui place l’ensemble dans la catégorie des systèmes capables d’opérer à distance avec une grande précision.

Au‑delà de la performance technique, c’est l’évolution des usages militaires qui interpelle. L’idée d’un robot à quatre pattes, agile, équipé d’un fusil, évoque une bascule symbolique: on ne parle plus seulement de robots d’inspection ou de logistique, mais de plateformes potentiellement létales.

Pourquoi cette annonce inquiète

Plusieurs spécialistes de l’IA et des conflits armés estiment que l’on franchit une ligne morale, juridique et technique. Selon eux, armer ce type de plateforme ouvre la porte à une diffusion vers des acteurs non étatiques, des États voyous ou des groupes terroristes. Dans un tel scénario, ces robots ne seraient pas seulement des armes sur le champ de bataille, mais de véritables outils d’intimidation et de terreur dans l’espace civil.

Ils soulignent aussi un effet d’entraînement: une fois la barrière psychologique franchie, la normalisation d’armes autonomes pourrait s’accélérer, rendant ensuite la régulation plus difficile et tardive.

L’autonomie, la question qui fâche

Le point le plus sensible reste le degré d’autonomie. Personne ne sait exactement jusqu’où le Q-UGV armé peut décider ou agir sans supervision humaine. Mais les armées du monde entier brouillent déjà la frontière entre des systèmes téléopérés et des systèmes capables de sélectionner et d’engager une cible avec un minimum d’intervention humaine.

Des opérations récentes, comme l’élimination d’un scientifique en Iran par une arme robotisée assistée par IA, montrent que la technologie d’aide à la décision est déjà à l’œuvre. Pour de nombreux experts, ces signaux suffisent à justifier une urgence réglementaire, notamment dans le cadre des discussions à l’ONU sur les « systèmes d’armes autonomes létaux » (LAWS).

Ce que dit l’opinion publique et la communauté scientifique

Sur les réseaux sociaux, les réactions face au robot armé sont massivement hostiles. Beaucoup jugent insupportable l’idée de laisser une machine, même partiellement, s’approcher du pouvoir de décider de la mort d’un humain. Des figures de la recherche en IA rappellent que la science‑fiction a servi d’avertissement: l’automatisation de la violence n’est pas une simple amélioration logistique, c’est un changement de paradigme éthique.

Détails techniques et comparaison avec l’industrie

- Modèle de robot: Q-UGV (Ghost Robotics), une plateforme quadrupède agile, conçue pour la mobilité en terrain complexe.

- Arme: fusil de SWORD International, portée annoncée d’environ 1,2 km.

- Positionnement du secteur: Boston Dynamics, concurrent direct, a pris un engagement public à ne pas armer ses robots. L’entreprise s’est déjà opposée à l’ajout d’armes non létales (même un simple lance‑peinture) sur son robot Spot, proche du Q-UGV en taille et en usage.

Cette divergence de stratégie met en lumière une ligne de fracture dans la robotique: certains acteurs misent sur des applications civiles et industrielles, d’autres n’excluent pas l’intégration d’armes dans des contextes militaires.

Des voix plus nuancées

Des spécialistes des relations internationales comme Michael Horowitz estiment que, si l’humain conserve la main (détection, identification, décision de tir), le robot armé n’introduit pas de problème éthique totalement nouveau par rapport aux drones aériens armés déjà largement utilisés. Selon cette approche, tout dépend des détails techniques: qui contrôle quoi, quelles limites logicielles, quels verrous de sécurité, quelle traçabilité des décisions?

Ce que cela change maintenant

Cet épisode agit comme un point d’inflexion. Trois conséquences majeures se dessinent:

- Accélération de la régulation internationale: exigences d’« humain dans la boucle », transparence des algorithmes, audits indépendants, et interdictions ciblées (ex. autonomie complète dans la sélection/attaque de cibles humaines).

- Pression sur les normes industrielles: intégration de garde‑fous techniques (géorepérage, identifiants inviolables, journaux d’événements) et responsabilisation des fabricants.

- Débat public sur l’acceptabilité sociale: là où la robotique était perçue comme un outil de secours et d’inspection, l’image d’un quadrupède armé reconfigure l’imaginaire collectif et la confiance dans ces technologies.

En clair, le robot de Ghost Robotics ne se résume pas à un prototype impressionnant: il cristallise la question essentielle de notre époque technologique — quel pouvoir de coercition sommes‑nous prêts à déléguer aux machines, et sous quelles conditions?

FAQ

Quelle est la différence entre « automatisé » et « autonome » dans un système d’armes?

- Automatisé: la machine exécute des tâches prédéfinies; l’humain décide des objectifs critiques (ex. tirer ou non).

- Autonome: le système peut détecter, sélectionner et engager une cible avec une intervention humaine limitée, voire nulle.

Existe‑t‑il déjà des règles internationales contraignantes sur les armes autonomes?

Pas encore de traité universel spécifique. Les discussions avancent dans le cadre de la Convention sur certaines armes classiques (CCAC) à l’ONU, mais on en est surtout aux lignes directrices et aux positions nationales. Plusieurs États et ONG appellent à une interdiction préventive de certaines capacités.

Quels garde‑fous techniques peuvent réduire les risques?

- « Humain dans/sur la boucle » pour la décision de tir

- Géorepérage et zones d’exclusion

- Journalisation cryptée des décisions

- Coupe‑circuits physiques et logiciels

- Limitation des cibles à du matériel (contre‑matériel) au lieu de personnes

Les robots quadrupèdes ont‑ils des usages civils utiles?

Oui: inspection de sites dangereux, recherche et secours, cartographie 3D, sécurité périmétrique, logistique légère. Leur mobilité en terrain difficile est un atout majeur.

Ces systèmes sont‑ils vulnérables au piratage ou au brouillage?

Comme tout système connecté, ils peuvent l’être. D’où l’importance d’architectures résilientes, d’un chiffrement robuste, de canaux de communication redondants et de procédures de reprise en main manuelle en cas d’attaque.