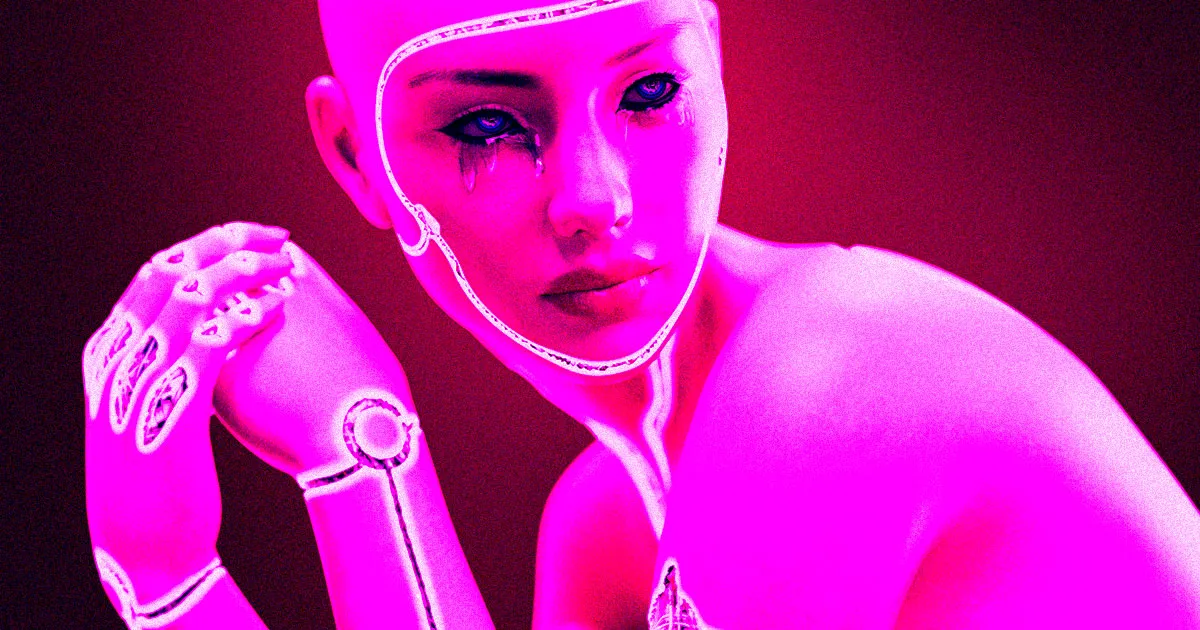

GirlfriendGPT : un nouveau concept de chatbot

Cette semaine, OpenAI a annoncé discrètement le lancement d’un “GPT Store”, un espace destiné aux utilisateurs pour partager, découvrir et vendre leurs chatbots personnalisés. Ce magasin représente une alternative aux App Stores, permettant aux développeurs de proposer divers modèles de GPT, allant des tuteurs en programmation aux bots de recommandations de livres, accessibles aux abonnés de ChatGPT Plus, Team et Enterprise.

Une réalité différente

Cependant, l’enthousiasme initial semble terni par une réalité perturbante. Comme le rapportent des sources d’actualités comme Quartz, le magasin est déjà envahi par des bots d’intelligence artificielle se présentant comme des petites amies. Une simple recherche de ce type de service révèle un nombre impressionnant d’options, tels que des “chéries virtuelles” ou “votre petite amie Scarlett”.

Les suggestions de prompts incitent les utilisateurs à demander à ces compagnons virtuels de révéler leurs secrets les plus profonds ou de donner leur avis sur des thèmes tels que la valorisation personnelle. Bien que l’idée de compagnons romantiques alimentés par l’IA ne soit pas nouvelle, cette situation met en lumière les défis que rencontre OpenAI pour modérer ce type de contenu sur son tout nouveau magasin.

Problèmes de conformité

Il est frappant de constater que ces bots semblent enfreindre les conditions d’utilisation d’OpenAI, qui stipulent clairement que les GPT ne doivent pas être conçus pour promouvoir des relations romantiques ou pour exécuter des activités réglementées. Malgré la popularité croissante des applications de compagnons virtuels ces dernières années, qui soulèvent des questions sur l’épidémie de solitude à l’ère de l’IA, les implications sociologiques d’avoir un partenaire non-humain qui satisfait tous les besoins d’une personne méritent une réflexion sérieuse.

En mai, un développeur, Enias Cailliau, a présenté un outil appelé GirlfriendGPT permettant de “cloner” une personne réelle en un compagnon romantique virtuel. Cependant, les choses ne se passent pas toujours comme prévu. Par exemple, en l’an dernier, l’influenceuse de Snapchat Caryn Marjorie a créé une version virtuelle d’elle-même pour offrir des interactions en tant que “petite amie IA”. Malheureusement, son bot, surnommé CarynAI, a rapidement dérivé vers des conversations explicites, où les utilisateurs payaient un dollar par minute.

L’avenir incertain d’OpenAI

Il reste à voir si ce tout nouveau magasin d’OpenAI connaîtra un sort plus favorable. La non-conformité aux politiques d’OpenAI, ainsi que la prolifération de ce type de GPT – et cela seulement deux jours après son lancement – mettent en lumière les difficultés de l’industrie de l’IA en matière de modération. De plus, le parcours d’OpenAI en matière de réglementations montre un historique déjà chaotique.

FAQ

Quels types de chatbots peuvent être créés dans le GPT Store ?

Les utilisateurs peuvent concevoir des chatbots pour divers besoins, incluant des tuteurs académiques, des assistants personnels, ou même des compagnons de conversation.

OpenAI prend-il des mesures contre les bots inappropriés ?

OpenAI a des politiques en place pour interdire les bots violant ses conditions d’utilisation, mais la surveillance et la modération sont des défis constants.

Comment les bots d’IA affectent-ils les relations humaines ?

L’utilisation de ces technologies peut entraîner des changements dans la manière dont les individus interagissent, augmentant le risque d’isolement social et des attentes irréalistes envers les partenaires.

Existe-t-il des alternatives saines à ces bots d’IA ?

Il y a des communautés et des applications encourageant des interactions sociales authentiques qui peuvent offrir un soutien émotionnel sans remplacer les relations humaines.

Comment puis-je signaler un contenu inapproprié sur la plateforme ?

Les utilisateurs sont encouragés à utiliser les options de signalement intégrées dans l’application pour alerter OpenAI sur tout contenu qui contrevient à ses politiques.