Une enquête révélatrice sur l’IA et la perception des médias

Dans une étude captivante menée par l’AI Policy Institute (AIPI), une organisation à but non lucratif dédiée à la recherche et à l’action, il a été découvert que 80 % des Américains estiment que faire passer un contenu généré par intelligence artificielle pour un travail humain devrait être considéré comme illégal.

Une question clé abordée

Cette enquête a soulevé une question pertinente :

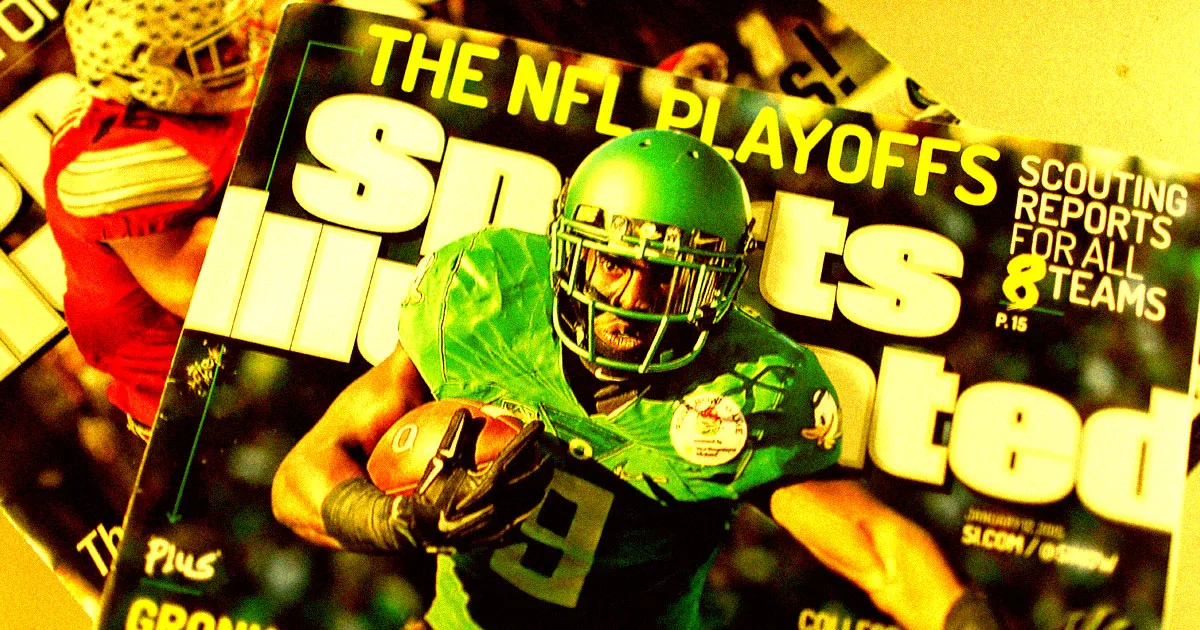

« Sports Illustrated a récemment admis avoir utilisé l’IA pour rédiger des articles, en leur attribuant des noms d’auteur fictifs. Pensez-vous que cette pratique devrait être légale ou illégale ? »

Cette interrogation fait référence à une polémique, où Sports Illustrated a publié des articles avec des auteurs fictifs, utilisant des noms inventés ainsi que des photos générées par IA.

Précisions sur l’enquête

Il est intéressant de noter que la formulation de la question par l’AIPI présente certaines ambiguïtés. Bien qu’il n’y ait pas de contestation sur le fait que les auteurs de Sports Illustrated étaient fictifs et que les images étaient générées par IA, la publication et son propriétaire ont nié avoir utilisé l’IA pour créer le contenu des articles, affirmant que celui-ci avait été fourni par un contractant tiers, nommé AdVon Commerce, qui a également démenti l’utilisation d’IA. Nos sources, toutefois, suggèrent que plusieurs articles ont effectivement été produits avec l’aide de l’IA.

Les perceptions du public sur l’IA dans les médias

Malgré ces nuances, les résultats de cette enquête offrent un aperçu intéressant de la perception du public quant à l’utilisation de l’IA dans les médias. Un grand nombre d’Américains exprime un désaccord concernant l’idée que les éditeurs leur fournissent du contenu généré par IA – et encore pire, du contenu signé par des auteurs générés par IA – sans divulgation appropriée. Alors que nous avançons vers une époque où l’IA pourrait jouer un rôle central, ces résultats devraient interpeller les éditeurs.

Les questions posées dans l’enquête

D’après l’enquête, 1 222 Américains ont été interrogés sur quatre questions liées à l’incident de Sports Illustrated concernant l’utilisation de l’IA. Ces questions incluaient si l’utilisation de l’IA pour « écrire des articles » et les « attribuer à des faux auteurs » était éthique ; si une telle pratique devrait être considérée comme totalement illégale ; si les entreprises devraient être tenues de divulguer et de marquer le contenu créé par IA ; et enfin, si les publicités politiques devraient également être soumises aux mêmes exigences.

Les deux premières questions ont suscité des réponses très marquées, avec 84 % des répondants jugeant l’utilisation de l’IA dans ce contexte non éthique et 80 % la considérant comme strictement illégale. Ce sentiment semble transcender les clivages partisans, les Démocrates, Républicains et indépendants se positionnant relativement proches dans leurs réponses.

Une réflexion sur le besoin de transparence

Les réponses concernant le watermarking (marquage) sont délicates et moins nettes, ce qui pourrait s’expliquer par le fait que ces questions portent sur une solution spécifique. Une personne pourrait juger qu’une absence de divulgation concernant l’IA est problématique, tout en ayant des doutes sur l’efficacité réelle du watermarking. Il est également possible qu’ils ne comprennent pas totalement ce que cela impliquerait, ou qu’ils privilégient d’autres solutions, comme l’exigence pour les éditeurs de signaler l’utilisation de l’IA par des dispositions explicites.

Conclusion

Bien que ces résultats d’enquête soient passionnants, ils ne sont pas vraiment surprenants. La divulgation de l’utilisation de l’IA touche les droits fondamentaux des consommateurs. Les utilisateurs souhaitent savoir ce qu’ils consomment, et il est légitime de leur en donner la possibilité. Si un éditeur choisit d’explorer l’IA, il se doit d’offrir aux lecteurs l’opportunité de décider comment et s’ils veulent s’engager avec ce type de contenu. Si un éditeurs omet de clarifier l’utilisation de l’IA, que ce soit par obscurcissement volontaire ou non, c’est un manquement aux principes éthiques des médias.

FAQ

Qu’est-ce que l’intelligence artificielle (IA) ?

L’IA désigne des systèmes informatiques capables d’effectuer des tâches normalement réservées à l’intelligence humaine, telles que la compréhension du langage, la reconnaissance d’images ou la prise de décision.

Pourquoi la transparence est-elle essentielle dans les médias ?

La transparence permet aux consommateurs de faire des choix éclairés. Elle est cruciale pour maintenir la confiance du public envers les médias et leurs pratiques.

Comment fonctionne le watermarking dans le contexte de l’IA ?

Le watermarking est un processus qui consiste à apposer une marque ou un identifiant sur un contenu pour indiquer qu’il a été généré par une IA, afin d’informer les utilisateurs et de garantir une certaine transparence.

Quels seraient les impacts d’une réglementation stricte sur l’IA dans les médias ?

Une réglementation stricte pourrait amener les éditeurs à utiliser l’IA de manière plus responsable, favorisant ainsi la transparence et la fiabilité des informations diffusées.

Quelles autres solutions pourraient être envisagées en matière de régulation de l’IA dans les médias ?

D’autres solutions incluent la mise en place de disclaimers explicites sur le contenu révolutionné par IA, ou la création de normes sectorielles pour l’utilisation de l’IA dans le journalisme et les publications.